8가지 최고의 오픈 소스 AI 비디오 업스케일러 (무료 & 오프라인 도구)

모든 사람이 고급 AI 비디오 업스케일러를 위한 예산을 가지고 있는 것은 아닙니다. Reddit, GitHub, 또는 비디오 편집 포럼을 탐색해본 적이 있다면 아마도 같은 질문을 하는 사람들을 자주 보았을 것입니다: "좋은 오픈 소스 AI 비디오 업스케일러가 있을까요?"

상업적인 옵션들은 종종 세련되고 강력하지만, 일부 오픈 소스 프로젝트도 주목을 받고 있습니다. 이들은 업스케일링, 디블러링, 디노이징과 같은 AI 기반 기능을 제공하면서도 가격이 들지 않습니다. 일부는 애니메이션 콘텐츠를 위해 특별히 설계된 반면, 다른 것들은 일반적인 비디오 향상을 목표로 합니다. 그런데 실제로 얼마나 효과적일까요? 그리고 이를 사용할 때 어떤 종류의 거래가 따를까요?

이 글에서는 오늘날 사용 가능한 가장 인기 있는 무료 오픈 소스 AI 비디오 업스케일러와 향상 도구들에 대해 다루며, 이들이 잘하는 점, 부족한 점, 그리고 설치 및 사용 시 어떤 점을 기대할 수 있는지 소개합니다.

오픈 소스 프로젝트는 환상적이지만, 이를 실행하는 데는 고생이 따릅니다. Python 의존성 문제, 복잡한 명령어, 느린 처리 속도는 창작 작업에 끼어들지 말아야 합니다.

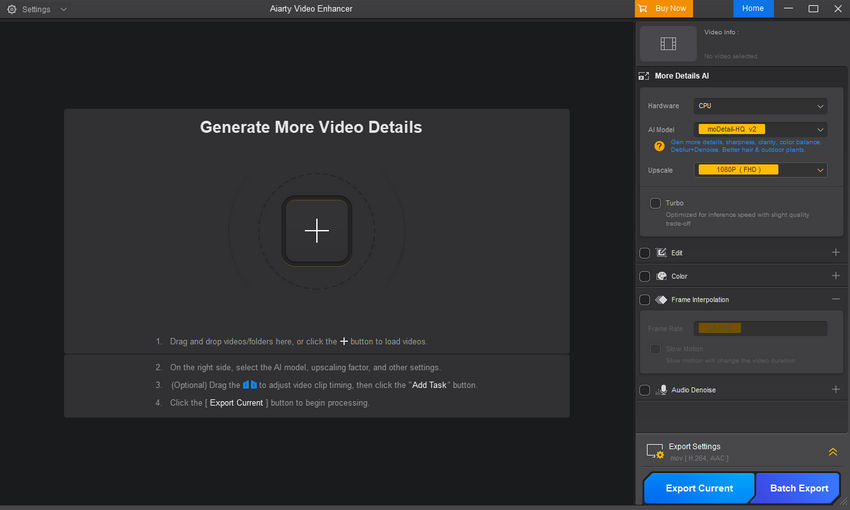

Aiarty Video Enhancer는 이러한 문제를 해결합니다. 간단하고 사용자 친화적인 GUI 인터페이스에서 전문적인 AI 업스케일링, 디노이징, 디블러링 등을 제공합니다. 아래의 유튜브 비디오에서 테스트 예시를 확인하실 수 있습니다.

한정 특별 제공: 현재 시간 한정 무료 제공 이벤트를 진행 중입니다! 지금 바로 무료 라이센스를 받으시고, 비디오를 향상시키기 시작하세요.

인기 있는 무료 오픈 소스 AI 비디오 업스케일러/향상 도구

AI를 활용해 비디오를 업스케일하거나 향상한다고 주장하는 오픈 소스 도구는 매우 다양합니다. 일부는 연구자들이 개발하고 GitHub 기여자들이 유지 관리하는 프로젝트이며, 또 일부는 개인 개발자가 실용적인 일상 사용을 위해 다듬은 형태입니다.

아래는 사람들이 자주 사용하는 가장 인기 있는 무료 오픈 소스 비디오 업스케일러 및 향상 도구들입니다. 각 도구는 고유한 강점과 한계, 그리고 사용 전에 알아두어야 할 특징들을 가지고 있습니다.

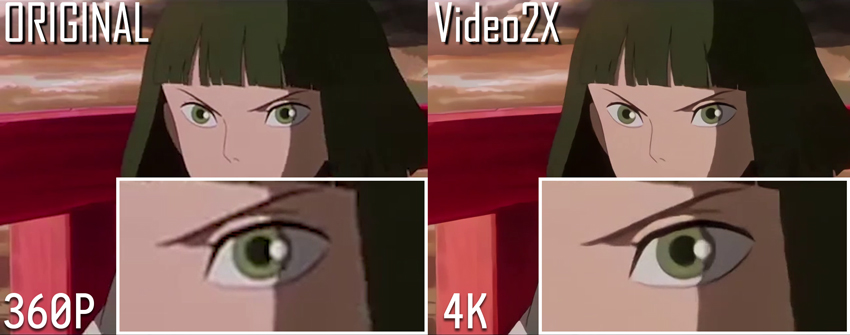

Video2X

지원 플랫폼: Windows (완전 지원), Linux (제한적 지원)

Video2X는 AI 기반 이미지 업스케일러를 활용해 비디오를 업스케일하는 인기 있는 오픈 소스 도구입니다. 이 도구는 비디오를 개별 프레임으로 추출한 뒤, AI 업스케일러로 각 프레임을 확대하고, 이를 다시 합쳐 고해상도 비디오를 생성하는 방식으로 작동합니다.

전체 과정은 여러 단계로 이루어집니다:

- 프레임 추출: Video2X는 먼저 FFmpeg를 사용해 비디오를 개별 프레임과 오디오 파일로 분리합니다.

- 프레임 업스케일링: 각 프레임은 waifu2x, SRMD, Anime4KCPP와 같은 지원 AI 모델을 통해 업스케일됩니다. 업스케일 모델은 사용자 정의가 가능하며, 애니메이션 또는 실사 영상 등 콘텐츠 유형에 맞게 선택할 수 있습니다.

- 비디오 재구성: 프레임 처리가 완료되면 FFmpeg가 업스케일된 프레임과 원본 오디오를 다시 결합하여 최종 고해상도 비디오를 생성합니다.

이 과정은 특히 긴 영상이나 GPU 가속이 없는 경우 매우 느릴 수 있습니다.

스크립팅에 익숙한 고급 사용자의 경우, 비디오 분할 및 병합 과정을 포함한 간단한 배치 또는 bash 스크립트를 직접 작성하여 더 높은 수준의 자동화와 커스터마이징을 구현할 수 있습니다.

Windows 사용자는 간단한 그래픽 인터페이스를 사용할 수 있지만, Linux 사용자는 대부분 명령줄 환경에 의존해야 합니다.

- 다양한 AI 백엔드를 지원하여 콘텐츠 유형에 맞게 선택 가능

- Windows GUI 제공으로 비전문 사용자도 비교적 쉽게 사용 가능

- 배치 처리 지원으로 긴 영상이나 폴더 단위 작업 가능

- 완전 무료 오픈 소스이며 기능 제한이나 워터마크 없음

- GPU 없이 처리 속도가 매우 느림 (NVIDIA GPU 권장)

- 오디오가 자동으로 함께 처리되지 않아 별도 재결합 필요

- 설치 및 모델 설정이 초보자에게 다소 복잡함

- Linux 지원은 제한적이며 수동 설정 필요

- macOS에서는 기본적으로 실행되지 않음

설치 및 사용 방법:

1. 컴퓨터에 Video2X 프로젝트 빌드하기

- Windows에서 Video2X 빌드 방법 확인: https://docs.video2x.org/building/windows.html

- Windows에서 Video2X Qt6 GUI 빌드 방법 확인: https://docs.video2x.org/building/windows-qt6.html

- Linux에서 Video2X 빌드 방법 확인: https://docs.video2x.org/building/linux.html

2. Video2X 다운로드 및 설치

Video2X를 원활하게 실행하려면 시스템이 다음 최소 하드웨어 요구 사항을 충족해야 합니다.

CPU

- 사전 컴파일된 바이너리는 AVX2를 지원하는 CPU가 필요합니다.

- Intel: Haswell (2013년 2분기) 또는 이후 모델

- AMD: Excavator (2015년 2분기) 또는 이후 모델

GPU

- GPU는 Vulkan을 지원해야 합니다.

- NVIDIA: Kepler (GTX 600 시리즈, 2012년 2분기) 또는 이후 모델

- AMD: GCN 1.0 (Radeon HD 7000 시리즈, 2012년 1분기) 또는 이후 모델

- Intel: HD Graphics 4000 (2012년 2분기) 또는 이후 모델

팁: 강력한 GPU가 없는 경우에도 Google Colab에서 Video2X를 무료로 사용할 수 있습니다. Google은 NVIDIA T4, L4, A100과 같은 고성능 GPU를 제공하며, 세션당 최대 12시간까지 사용할 수 있습니다.

Windows 설치 방법 (명령줄 버전)

최신 사전 컴파일 릴리스는 GitHub에서 다운로드할 수 있습니다. 로컬 사용자 디렉토리에 설치하는 방법은 다음과 같습니다:

압축을 해제한 후, 쉽게 접근할 수 있도록 %LOCALAPPDATA%\Programs\video2x를 시스템 환경 변수에 추가하세요.

Windows Qt6 GUI 설치 방법

그래픽 인터페이스를 선호하는 경우, Video2X Qt6 버전이 더 깔끔한 사용 경험을 제공합니다. 릴리스 페이지에서 video2x-qt6-windows-amd64-installer.exe 설치 파일을 다운로드한 후 더블 클릭하여 실행하세요.

설치 마법사가 설치 과정을 안내합니다. 설치 경로를 선택하거나 바탕화면 바로가기를 생성할 수도 있습니다.

Linux 설치 방법

Linux 사용자는 공식 Linux 설치 가이드를 참고하세요.

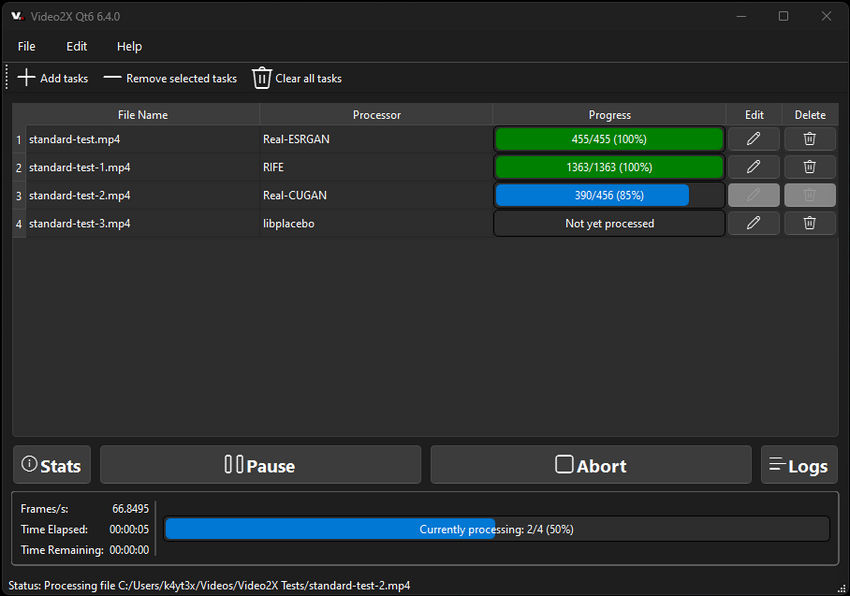

3. Video2X 실행하기

Video2X는 명령줄 또는 Windows GUI를 통해 실행할 수 있습니다.

명령줄 사용 시, CLI 문서를 참고하세요. 입력 및 출력 경로, realesrgan과 같은 AI 모델, 출력 옵션 등을 설정할 수 있습니다.

예시 명령어:

GUI를 사용하는 경우 Video2X Qt6를 실행하고 비디오를 불러온 뒤 GPU 백엔드, 처리 모드, 필터 등을 설정한 후 Run 버튼을 클릭하면 업스케일링이 시작됩니다.

Real-ESRGAN

지원 플랫폼: Windows, Linux, macOS

Real-ESRGAN은 ESRGAN 팀에서 개발한 널리 사용되는 무료 오픈 소스 AI 이미지 및 비디오 업스케일러입니다. PyTorch 프레임워크를 기반으로 하며, 사전 학습된 생성적 적대 신경망(GAN)을 활용해 고품질 이미지 및 비디오 업스케일링을 제공합니다. 원래는 단일 이미지 초해상도(Super-Resolution)를 위해 설계되었지만, 프레임 단위로 처리하는 방식으로 비디오에도 적용할 수 있어 저해상도 또는 압축된 영상 복원에 매우 강력한 선택지입니다.

특히 풍경, 얼굴, 저화질 스마트폰 영상과 같은 실제 환경 기반 콘텐츠에서 뛰어난 성능을 보여주며, 노이즈와 압축 아티팩트를 줄이면서 디테일을 복원하는 능력으로 잘 알려져 있습니다.

- 실사 사진 및 영상에서 특히 뛰어난 최첨단 화질 개선 성능

- 다양한 사전 학습 모델 제공 (일반, 애니메이션, 얼굴 복원 등)

- 활발하게 유지보수되며 강력한 연구 팀에 의해 지원됨

- 스크립트 또는 커스텀 비디오 워크플로우에 통합 가능

- 기본 GUI 없음 (명령줄 또는 수동 스크립트 필요)

- 비디오 사용 시 프레임 추출 및 재결합을 직접 처리해야 함 (자동화되지 않음)

- Python 환경과 PyTorch에 대한 기본 이해 필요

- CPU에서는 매우 느리며, 실사용에는 GPU가 거의 필수

설치 및 사용 방법:

1. Python 및 의존성 설치

- Python 3.7 이상이 설치되어 있는지 확인하세요

- 레포지토리 클론:

- 필요 패키지 설치

cd Real-ESRGAN

# BasicSR은 학습과 추론 모두에 사용됩니다

pip install basicsr

# facexlib 및 gfpgan은 얼굴 향상용

pip install facexlib

pip install gfpgan

pip install -r requirements.txt

python setup.py develop

2. 사전 학습 모델 다운로드

이 프로젝트는 다양한 모델을 지원합니다:

- RealESRGAN_x4plus (일반 용도)

- RealESRGAN_x4plus_anime_6B (애니메이션 이미지)

- realesr-general-x4v3 (압축된 이미지용)

필요한 .pth 모델 파일을 GitHub 릴리스 또는 제공된 링크에서 다운로드하세요.

3. 비디오 준비 (프레임 추출)

FFmpeg를 사용해 입력 비디오에서 프레임을 추출합니다:

4. 추출된 프레임에 Real-ESRGAN 실행

예시 명령어 (4배 업스케일링):

5. 프레임을 다시 비디오로 결합

FFmpeg를 다시 사용합니다:

6. (선택) 원본 영상에서 오디오 추가

Real-ESRGAN은 Python과 명령줄 도구에 익숙한 사용자, 또는 고품질 업스케일링을 자동화된 파이프라인에 통합하려는 사용자에게 가장 적합합니다. GUI 기반 옵션보다 설정이 더 기술적이지만, 특히 흐릿하거나 저해상도 영상에서 디테일을 복원할 때 그 결과는 충분히 그 차이를 보여줍니다.

팁: Video2X와 마찬가지로 Real-ESRGAN도 Google Colab에서 실행할 수 있습니다. 강력한 로컬 GPU 없이도 이 영상을 참고하면 Colab을 활용해 HD 또는 4K로 비디오 업스케일링하는 방법을 확인할 수 있습니다.

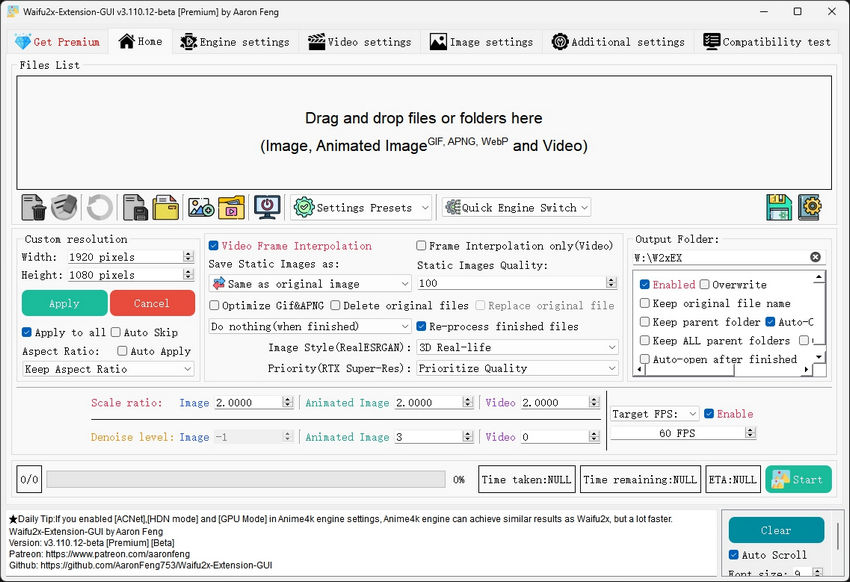

Waifu2x Extension GUI

지원 플랫폼: Windows

Waifu2x Extension GUI는 waifu2x, Real-ESRGAN, Anime4K 등 여러 AI 업스케일러를 하나의 그래픽 인터페이스로 통합한 사용자 친화적인 Windows 전용 데스크톱 애플리케이션입니다. 원래는 애니메이션 스타일 이미지와 영상을 위해 설계되었지만, 이후 추가 모델 지원을 통해 실사 콘텐츠까지 확장되었습니다. 명령줄 작업 없이도 쉽게 설치하고 사용할 수 있어 높은 평가를 받고 있습니다.

다른 많은 오픈 소스 도구들과 달리 Waifu2x Extension GUI는 편의성에 초점을 맞추고 있습니다. 프레임 추출, 업스케일링, 비디오 재구성, 심지어 오디오 동기화까지 하나의 인터페이스에서 모두 처리할 수 있습니다. 이 덕분에 Windows에서 AI 기반 비디오 향상을 처음 접하는 사용자에게 가장 친숙한 옵션 중 하나로 꼽힙니다.

- 이미지, GIF, 비디오 업스케일링을 모두 지원하는 올인원 GUI

- 여러 AI 백엔드 지원 (waifu2x-ncnn-vulkan, Real-ESRGAN, Anime4K, SRMD)

- FFmpeg 명령어 없이도 비디오/오디오 자동 결합 지원

- 배치 처리 및 고급 설정 제공 (숙련자용 기능 포함)

- Python 또는 외부 의존성 설치 불필요

- Windows 전용 (macOS 및 Linux 미지원)

- 저사양 GPU에서는 처리 시간이 오래 걸릴 수 있음

- 모델 옵션 및 업데이트는 개발자 유지보수에 의존

- 번들 모델과 의존성으로 인해 설치 용량이 큼 (약 1.5GB)

설치 및 사용 방법:

1. 설치 파일 다운로드

프로젝트의 GitHub 또는 Gitee 릴리스 페이지로 이동하세요: https://github.com/AaronFeng753/Waifu2x-Extension-GUI. 최신 .exe 버전(예: Waifu2x-Extension-GUI-v...-Installer.exe)을 선택하여 다운로드합니다.

2. 설치 및 프로그램 실행

설치 파일을 실행하세요. 설치가 완료되면 데스크톱 바로가기 또는 시작 메뉴에서 애플리케이션을 실행합니다.

3. 비디오 불러오기

비디오 파일을 프로그램에 드래그 앤 드롭하거나, "Add Files" 버튼을 클릭하여 입력 파일을 선택합니다.

4. 업스케일링 설정 선택

- AI 모델 선택 (예: Real-ESRGAN, waifu2x-ncnn-vulkan, Anime4KCPP)

- 출력 해상도 배율 설정 (예: 2× 또는 4×)

- 선택 사항: 노이즈 제거, 프레임 보간, 아티팩트 감소 적용

5. 처리 시작

"Start" 버튼을 클릭하면 앱이 자동으로 모든 과정을 처리합니다: 프레임 추출, 업스케일링, 비디오 재구성, 오디오 동기화까지 자동으로 수행됩니다.

6. 출력 파일 확인

업스케일된 비디오는 지정된 출력 폴더에 저장되며, 바로 사용하거나 업로드할 수 있습니다.

Waifu2x Extension GUI는 코드나 복잡한 환경 설정 없이도 안정적인 AI 업스케일링 결과를 원하는 사용자에게 이상적인 도구입니다. 스크립트 기반 도구보다 커스터마이징은 제한적이지만, 특히 애니메이션이나 저해상도 웹 비디오에서 바로 사용할 수 있는 완성도 높은 경험을 제공합니다.

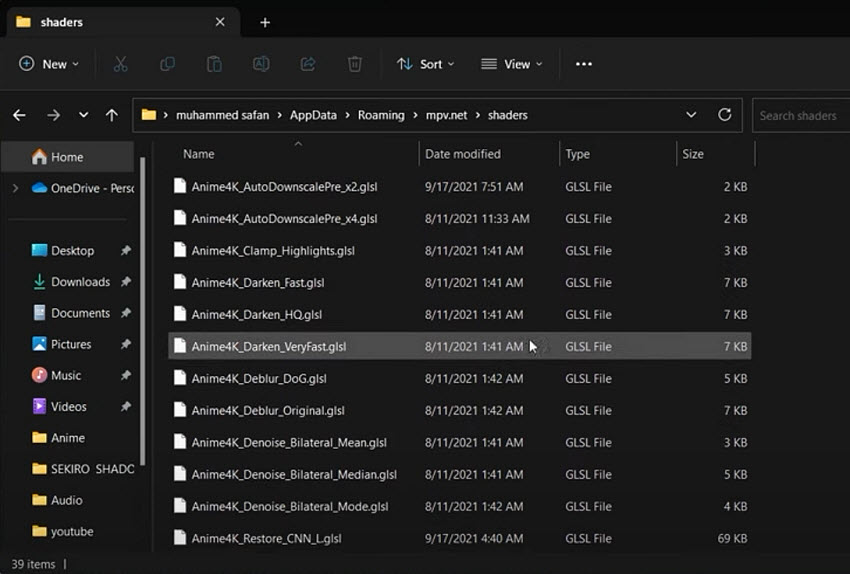

Anime4K

지원 플랫폼: Windows, macOS, Linux (비디오 플레이어 또는 커스텀 스크립트를 통해 사용)

Anime4K는 애니메이션 및 라인 아트 콘텐츠에 특화된 경량 오픈 소스 비디오 업스케일링 알고리즘입니다. 딥러닝이나 GAN 모델에 의존하는 다른 도구들과 달리, Anime4K는 GPU에서 직접 실행되는 효율적인 OpenCL 또는 Vulkan 셰이더를 사용합니다. 이로 인해 매우 빠르며 실시간 처리가 가능하고, 저사양 하드웨어에서도 사용할 수 있습니다.

Anime4K는 비디오 프레임을 추출하고 재구성하는 방식 대신, 주로 MPV나 VLC 같은 비디오 플레이어에서 셰이더 스크립트를 통해 사용됩니다. 또한 FFmpeg 필터나 명령줄 도구를 통해 오프라인 적용도 가능하지만, 가장 큰 장점은 실시간 재생 향상입니다. 이를 통해 오래된 애니메이션이나 저해상도 웹 비디오도 즉시 더 선명하고 깔끔하게 볼 수 있습니다.

- 거의 지연 없이 실시간 향상 가능

- 매우 가벼움 — 내장 GPU에서도 실행 가능

- 애니메이션, 카툰, 라인 아트 스타일 콘텐츠에 최적화

- MPV, VLC 또는 커스텀 스크립트에서 사용 가능 — 별도의 프레임 추출 불필요

- 크로스 플랫폼 지원

- 사진 또는 실사 영상에는 적합하지 않음

- GUI 또는 패키지 설치 프로그램이 없음

- 비디오 플레이어와 통합하려면 수동 설정 필요

- 딥러닝 기반 업스케일러보다 출력 디테일이 부족할 수 있음

설치 및 사용 방법:

옵션 1: MPV를 통한 실시간 재생

- MPV 플레이어 다운로드: https://mpv.io/

- Anime4K 저장소 클론 또는 다운로드: https://github.com/bloc97/Anime4K

- 셰이더 파일 (예: Anime4K_Clamp_Hybrid.glsl)을 MPV shaders 폴더에 넣습니다.

- mpv.conf 파일을 수정하여 셰이더 활성화: glsl-shaders="~~/shaders/Anime4K_Clamp_Hybrid.glsl"

- MPV로 비디오를 열면 실시간으로 향상이 적용됩니다.

옵션 2: FFmpeg를 이용한 오프라인 처리 (고급 사용자용)

일부 포크 버전(예: Anime4KCPP)은 비디오 파일에 직접 Anime4K 필터를 적용하는 방법을 제공하지만, 이를 사용하려면 도구를 직접 컴파일하거나 셰이더 지원이 포함된 특정 FFmpeg 빌드를 사용해야 하므로 초보자에게는 적합하지 않습니다.

Anime4K는 저해상도 애니메이션 콘텐츠를 즉시 시각적으로 개선하고 싶은 애니메이션 팬이나 사용자에게 가장 적합합니다. Real-ESRGAN이나 Video2X 같은 AI 모델처럼 깊이 있는 복원 기능은 제공하지 않지만, 빠른 속도와 단순한 구조 덕분에 재생용 또는 가벼운 화질 개선 용도로 매우 유용합니다.

보시다시피 오픈 소스 비디오 향상 도구는 매우 다양한 형태로 존재합니다 — Waifu2x Extension GUI처럼 사용하기 쉬운 GUI 기반 도구부터 Anime4K처럼 가벼운 셰이더 기반 솔루션까지 다양합니다.

이러한 도구들은 강력하고 무료라는 장점이 있지만, 동시에 초보자뿐 아니라 숙련된 사용자에게도 불편할 수 있는 몇 가지 트레이드오프를 가지고 있습니다.

다음 섹션에서는 이러한 오픈 소스 솔루션을 사용할 때 사람들이 자주 겪는 일반적인 문제들을 살펴보겠습니다.

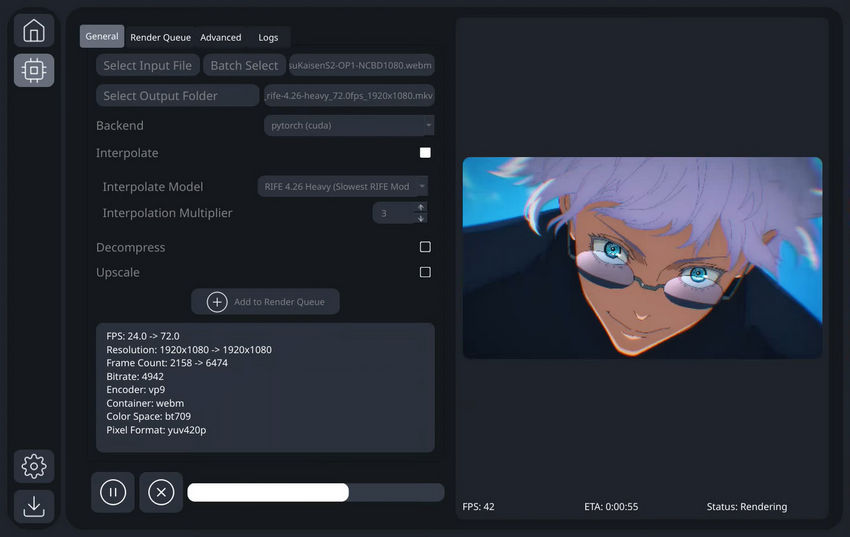

REAL Video Enhancer

지원 플랫폼: Windows, Linux, macOS

REAL Video Enhancer는 AI 기반 비디오 향상을 위한 올인원 데스크톱 애플리케이션으로, 프레임 보간과 업스케일링 기능을 포함합니다. Flowframes와 같은 기존 소프트웨어의 현대적인 크로스 플랫폼 대안으로 설계되었으며, 명령줄 지식 없이도 사용할 수 있는 사용자 친화적인 경험을 제공합니다.

이 애플리케이션은 RIFE를 활용한 비디오 프레임 보간, Real-ESRGAN을 이용한 업스케일링 등 최신 AI 모델을 사용합니다. 또한 TensorRT와 NCNN 같은 고도로 최적화된 추론 엔진을 활용해 최신 GPU 환경에서 성능을 극대화합니다. 많은 GUI 도구와 달리 REAL Video Enhancer는 주요 데스크톱 운영체제를 모두 지원하여 다양한 사용자에게 적합한 선택지입니다.

- Windows, Linux, macOS를 지원하는 크로스 플랫폼 호환성

- TensorRT 및 NCNN 백엔드를 활용한 고성능 최적화

- 프레임 보간(RIFE), 업스케일링(Real-ESRGAN), 비디오 압축 해제 기능을 하나의 인터페이스로 통합

- 직관적이고 사용하기 쉬운 GUI 제공

- Discord RPC 연동, 장면 전환 감지, 실시간 렌더 프레임 미리보기 등 고급 기능 포함

- 리소스 요구량이 높아 최소 8GB VRAM과 16GB RAM 이상의 고성능 GPU 필요

- TensorRT 버전은 모델과 의존성 포함으로 최대 16GB까지 다운로드 용량이 커질 수 있음

- 특정 GPU 및 운영체제에 성능이 의존되어 최적 성능을 위해 하드웨어 요구사항이 까다로움

설치 및 사용 방법

1. 애플리케이션 다운로드

공식 GitHub 프로젝트 페이지로 이동하세요: https://github.com/TNTwise/REAL-Video-Enhancer/releases/tag/RVE-2.3.6.

운영체제에 맞는 버전(Windows .exe, Linux .flatpak, macOS .dmg)을 다운로드합니다.

2. 설치 및 실행

다운로드한 설치 파일을 실행하고 안내에 따라 설치를 완료하세요. 설치가 끝나면 데스크톱 또는 애플리케이션 폴더에서 프로그램을 실행합니다.

3. 비디오 파일 불러오기

"General" 탭에서 "Select Input File" 또는 "Batch Select"를 클릭하여 처리할 비디오를 가져옵니다.

4. 처리 설정 구성

- Backend: GPU 성능을 활용하기 위해 pytorch (cuda)와 같은 적절한 백엔드를 선택합니다.

- Interpolate: 프레임 보간을 활성화하려면 이 옵션을 체크합니다.

- Interpolate Model: RIFE 4.26 Heavy와 같은 프레임 보간 모델을 선택합니다.

- Interpolation Multiplier: 프레임 보간 배수를 설정합니다 (예: 3 → 프레임 속도 3배 증가).

- Decompress: 비디오 압축 해제를 활성화하려면 체크합니다.

- Upscale: 업스케일링을 활성화하고 해당 모델을 선택합니다.

5. 렌더 큐에 추가

모든 설정이 완료되면 "Add to Render Queue"를 클릭합니다. 이후 "Render Queue" 탭에서 대기 중인 작업을 관리할 수 있습니다.

6. 처리 시작

하단의 재생 버튼(►)을 클릭하여 처리 작업을 시작합니다.

REAL Video Enhancer의 직관적인 GUI는 복잡한 비디오 향상 작업을 쉽게 만들어 주며, 초보자도 손쉽게 시작할 수 있도록 도와줍니다.

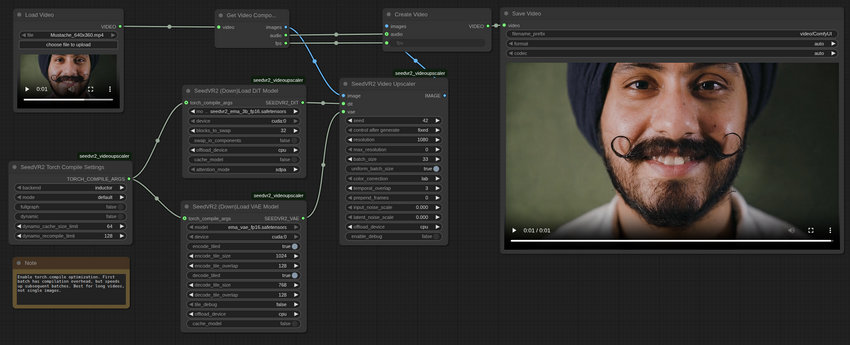

SeedVR2

지원 플랫폼: Windows, Linux, macOS (Python 환경 또는 ComfyUI 필요)

SeedVR2는 ByteDance 팀이 공개한 최신 오픈 소스 비디오 및 이미지 복원 모델입니다. 기존의 Real-ESRGAN과 같은 GAN 기반 도구와 달리, SeedVR2는 확산 모델(Diffusion Transformer) 아키텍처를 기반으로 구축되었습니다. 또한 One-step Adversarial Post-Training이라는 혁신적인 기법을 통해 확산 모델의 고질적인 단점인 느린 생성 속도를 해결했습니다.

그 결과 SeedVR2는 확산 모델 특유의 강력한 “환각(hallucination)” 능력—특히 매우 흐릿한 텍스처, 텍스트, 얼굴을 복원하는 데 뛰어난 성능—과 매우 빠른 추론 속도를 동시에 제공합니다. 노이즈 제거와 업스케일링이 단일 단계로 처리됩니다. 최고의 시각적 품질과 풍부한 디테일 복원을 동시에 원하는 사용자에게 SeedVR2는 현재 가장 최첨단에 가까운 오픈 소스 솔루션 중 하나입니다. 일반적으로 ComfyUI 플러그인 형태로 사용되거나 Python 환경에서 직접 실행됩니다.

- 확산 모델 기반으로 구동되며, 매우 사실적인 디테일을 재구성할 수 있어 심하게 흐려진 영상이나 저해상도 영상 복원에서 기존 GAN 모델보다 더 뛰어난 성능을 보이는 경우가 많습니다.

- 기존 확산 모델이 수십 번의 디노이징 스텝을 필요로 하는 것과 달리, SeedVR2는 단 한 번의 스텝으로 처리되어 속도가 크게 향상됩니다.

- 적응형 해상도 기술을 사용하여 일부 모델에서 발생하는 고정 입력 크기 제한 문제를 피할 수 있습니다.

- 동일한 모델 아키텍처로 비디오 복원과 이미지 초해상도를 모두 지원합니다.

- 추론 단계 수는 줄었지만, SeedVR2는 여전히 대형 Transformer 기반 모델이므로 특히 4K 비디오 처리 시 상당한 VRAM이 필요합니다.

- 주로 ComfyUI 워크플로우 또는 명령줄을 통해 사용되며, 원클릭 형태의 독립 실행형 GUI는 제공되지 않습니다.

- Python, PyTorch 및 관련 의존성 설정이 필요하여 초보자에게는 진입 장벽이 있을 수 있습니다.

설치 및 사용 방법

현재 SeedVR2를 사용하는 가장 쉬운 방법은 ComfyUI를 이용하는 것입니다. 아래는 ComfyUI에서 설치하고 실행하는 방법입니다:

1. ComfyUI 설치

아직 ComfyUI를 설치하지 않았다면 GitHub 저장소에서 다운로드하여 설치하세요. ComfyUI는 AI 이미지 및 비디오 처리를 위한 강력한 노드 기반 GUI입니다.

2. SeedVR2 커스텀 노드 설치

ComfyUI Manager를 통한 설치를 권장합니다:

- ComfyUI 인터페이스를 열고 “Manager”를 클릭합니다.

- “Install Custom Nodes”를 클릭합니다.

- “ComfyUI-SeedVR2_VideoUpscaler”를 검색합니다 (보통 numz 또는 유사 개발자가 관리).

- Install을 클릭한 후 ComfyUI를 재시작합니다.

3. 모델 다운로드

설치 후 필요한 모델 파일은 자동으로 다운로드되는 경우가 많습니다. 수동 다운로드가 필요한 경우 Hugging Face의 ByteDance-Seed/SeedVR2 저장소를 방문하여 모델 파일을 ComfyUI/models/checkpoints 또는 플러그인이 지정한 폴더에 넣으세요.

4. 워크플로우 로드

- ComfyUI에서 SeedVR2 예제 워크플로우를 로드합니다 (보통 플러그인 폴더의 JSON 파일 또는 “SeedVR2 ComfyUI workflow”로 온라인 검색 가능).

- “Load Video” 노드에 로컬 비디오 파일을 지정합니다.

- “Queue Prompt”를 클릭하여 처리를 시작합니다.

5. (선택) 명령줄 사용

개발자의 경우 SeedVR2는 공식 GitHub 저장소에서 직접 실행할 수도 있습니다:

cd SeedVR

pip install -r requirements.txt

python inference_seedvr2.py --input your_video.mp4 --output result.mp4

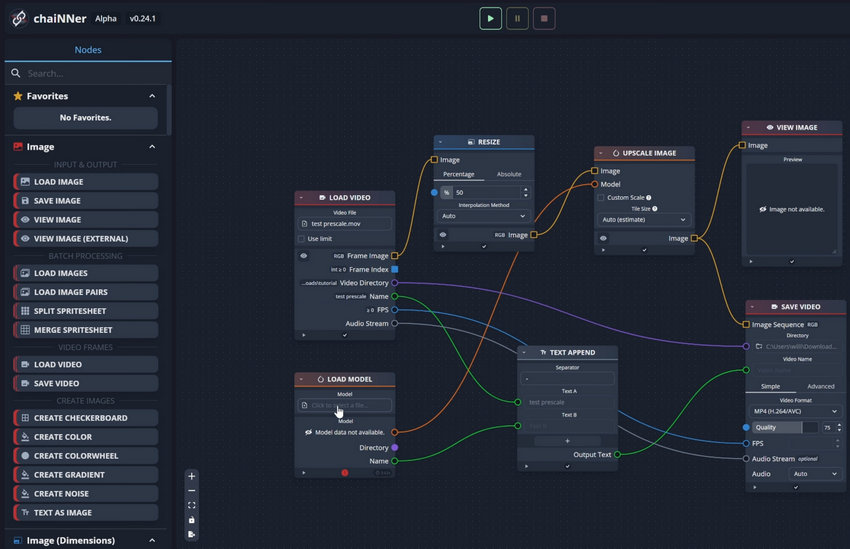

chaiNNer

지원 플랫폼: Windows, Linux, macOS

chaiNNer는 매우 강력한 오픈 소스 노드 기반 이미지 처리 GUI입니다. 이미지 워크플로우를 넘어, 유연한 노드 시스템 덕분에 비디오 업스케일링 및 향상 작업에도 높은 효율을 제공합니다. 기존의 “원클릭” 도구들과 달리 chaiNNer는 비디오 로딩, 모델 선택, 업스케일링, 출력 등 다양한 기능 노드를 연결하여 완전히 커스터마이징 가능한 파이프라인을 구성할 수 있습니다.

Real-ESRGAN, ESRGAN, SwinIR, HAT 등 다양한 주요 AI 업스케일링 알고리즘을 통합 지원합니다. 높은 수준의 커스터마이징과 모듈성 덕분에 chaiNNer는 고급 사용자들 사이에서 비디오 복원 및 향상 분야에서 가장 다재다능한 오픈 소스 솔루션 중 하나로 평가받고 있습니다.

- 노드 기반 워크플로우를 통해 로직이 명확하며, 필터, 색 보정, 여러 업스케일링 모델을 무제한으로 조합할 수 있음

- 대부분의 주요 오픈 소스 AI 모델을 지원하며 .pth 또는 .onnx 커스텀 모델도 가져와 사용할 수 있음

- Windows, macOS, Linux를 모두 지원하는 크로스 플랫폼 호환성과 NVIDIA, AMD, Intel GPU 하드웨어 가속 지원

- 배경 제거, 자동 크롭, 색 공간 변환 등 이미지 및 비디오 처리 기능을 폭넓게 제공

- 노드 기반 워크플로우에 익숙하지 않은 초보자에게는 학습 곡선이 매우 가파름

- Python 및 모델 파일 설치 등 초기 설정 과정이 다소 복잡함

- 복잡하고 긴 노드 체인을 구성할 경우 VRAM과 시스템 메모리 사용량이 크게 증가함

설치 및 사용 방법

chaiNNer는 시각적 워크스페이스를 통해 비디오 업스케일링 과정을 단순화합니다. 기본적인 비디오 향상 워크플로우 설정 방법은 다음과 같습니다:

1. chaiNNer 다운로드 및 설치

운영체제에 맞는 설치 파일은 공식 GitHub 저장소 또는 웹사이트에서 다운로드할 수 있습니다. 처음 실행 시 chaiNNer가 Python/PyTorch 등 필요한 의존성을 자동으로 설치할지 묻는데, 자동 설치를 허용하는 것을 권장합니다.

2. 비디오 및 AI 모델 불러오기

워크스페이스에서 우클릭하여 노드를 추가하거나 사이드바에서 드래그하여 사용할 수 있습니다:

- "Load Video" 노드를 추가하고 소스 파일을 선택합니다.

- "Load Model" 노드를 추가하고 호환되는 AI 모델 파일(예: Real-ESRGAN .pth 파일)을 지정합니다.

3. 업스케일링 체인 구성

노드를 연결하여 로직을 구성합니다:

- "Load Video" 노드의 Image 출력을 "Upscale Image" 노드의 Image 입력에 연결합니다.

- "Load Model" 노드의 Model 출력을 업스케일 노드의 Model 입력에 연결합니다.

- "Save Video" 노드를 추가합니다. 업스케일된 이미지 출력을 연결하고, "Load Video" 노드의 Audio 출력을 "Save Video"에 연결하여 원본 음성이 유지되도록 합니다.

4. 실행

"Save Video" 노드에서 출력 형식(MP4 또는 MOV)과 코덱을 설정합니다. 인터페이스 상단의 "Run" 버튼(재생 아이콘)을 클릭하면 chaiNNer가 프레임 단위로 비디오를 처리하고 원본 오디오와 함께 재구성합니다.

5. (선택) 배치 처리

여러 개의 비디오를 처리하려면 "Iterator" 노드 또는 "Batch Manager"를 사용하여 동일한 워크플로우를 폴더 전체에 적용할 수 있습니다.

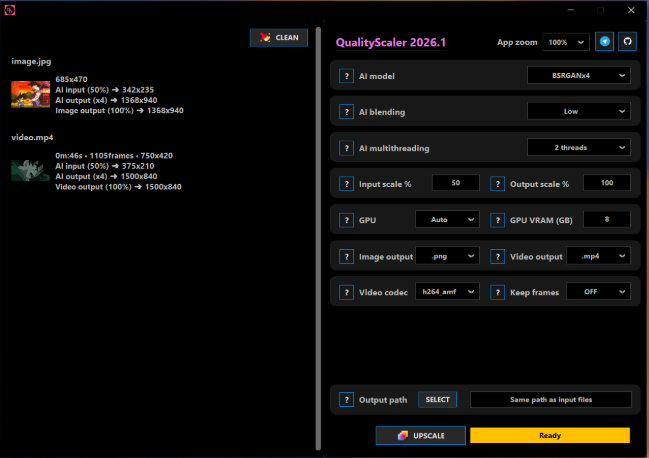

QualityScaler

지원 플랫폼: Windows 10/11 (Linux는 Wine/Proton 또는 소스 코드 실행 가능)

QualityScaler는 Djdefrag가 개발한 Windows 기반 AI 업스케일링 GUI 애플리케이션입니다. 명령줄 기반 도구와 달리 BSRGAN, Real-ESRGAN 같은 강력한 AI 모델을 실행할 수 있는 사용자 친화적인 인터페이스를 제공합니다. DirectML 기반으로 구축되어 있어 CUDA 설정 없이도 AMD, Intel, Nvidia 등 대부분의 최신 GPU와 높은 호환성을 제공합니다.

이 프로젝트는 GitHub에서 오픈 소스로 제공되지만, 편의성을 기준으로 “프리미엄 모델” 형태로 운영됩니다. 즉, 사용하기 쉬운 사전 컴파일 실행 파일은 Itch.io나 Steam에서 유료($7+)로 제공되며, 반면 소스 코드는 Python 스크립트를 직접 실행할 수 있는 개발자에게 무료로 공개되어 있습니다.

- 긴 비디오 업스케일링 작업을 위한 “Stop & Resume” 기능을 제공하며, 앱이 충돌할 경우 복원 지점을 생성함

- 완전히 오프라인으로 동작하며, 클라우드로 데이터가 전송되지 않음

- “다운로드 후 실행” 형태의 .exe 버전은 유료이며, 무료로 사용하려면 Python 소스 코드를 직접 설치해야 함

- Windows 중심으로 설계되어 있으며, Linux와 macOS 사용자는 호환 레이어를 사용하거나 Python 코드를 직접 실행해야 해서 불안정할 수 있음

- Python 기반 애플리케이션이기 때문에 동일 알고리즘의 C++ 최적화 구현 대비 속도가 느릴 수 있음

설치 및 사용 방법:

QualityScaler를 사용하는 방법은 두 가지가 있습니다: 쉬운 방법 (유료)과 개발자 방식 (무료)입니다.

옵션 1: 쉬운 방법 (유료 실행 파일)

기술적인 설정 없이 간단한 설치를 원하는 사용자에게 적합합니다.

- 구매: Djdefrag의 Itch.io 페이지 또는 Steam에서 QualityScaler를 구매합니다 (약 $7 USD).

- 설치: 설치 파일(.exe)을 다운로드하고 실행합니다.

- 실행: 앱을 실행한 뒤 비디오를 드래그 앤 드롭하고, 모델(예: Real-ESRGAN-x4-plus)을 선택한 후 "Start"를 클릭합니다.

옵션 2: 개발자 방식 (GitHub 무료 사용)

Python과 명령줄 사용에 익숙한 사용자에게 적합합니다.

1. 필수 프로그램 설치: Windows PC에 Python(3.10 이상)과 Git이 설치되어 있어야 합니다.

2. 저장소 클론:

git clone https://github.com/Djdefrag/QualityScaler.git

cd QualityScaler

3. 의존성 설치: 필요한 라이브러리를 설치합니다:

pip install -r requirements.txt

참고: 일부 경우 AI 모델과 ffmpeg.exe를 수동으로 다운로드하여 /AI-onnx 및 /Assets 폴더에 넣어야 할 수 있으며, 이는 README에 상세히 설명되어 있습니다.

4. 실행: Python으로 애플리케이션을 실행합니다:

python QualityScaler.py

오픈 소스 AI 비디오 업스케일러 사용 시 흔히 겪는 어려움

오픈 소스 AI 비디오 업스케일러는 뛰어난 기능을 제공하지만, 그만큼 진입 장벽이 높은 경우가 많습니다. 많은 사용자들이 별도의 설정 없이 바로 사용할 수 있는 “플러그 앤 플레이” 경험을 기대하고 다운로드하지만, 실제로는 기술적인 설정, 의존성 관리, 또는 여러 번의 시행착오가 필요하다는 것을 알게 됩니다. 아래는 사용자들이 가장 자주 겪는 대표적인 문제들입니다.

1. 복잡한 설치 및 설정 과정

많은 오픈 소스 AI 비디오 향상 도구는 Python, PyTorch 또는 기타 프레임워크에 의존하며, 이를 수동으로 설치해야 하는 경우가 많습니다. GitHub 저장소를 클론하고, 의존성을 설치하고, 환경 변수를 설정하거나 별도의 AI 모델을 다운로드해야 하는 등, 실제로 비디오를 한 번 처리하기까지 여러 준비 과정이 필요합니다. 이러한 도구에 익숙하지 않은 경우 전체 과정이 매우 부담스럽게 느껴질 수 있습니다.

2. 통합된 인터페이스의 부재

일반적으로 상용 툴은 세련된 UI와 간소화된 워크플로우를 제공하는 반면, 대부분의 오픈 소스 프로젝트는 AI 백엔드 기능 자체에 초점을 맞추는 경우가 많습니다. 그 결과 FFmpeg로 비디오 프레임을 추출하고, 별도로 업스케일링을 수행한 뒤, 다시 수동으로 영상을 재구성해야 하는 경우가 흔합니다. GUI 버전이 존재하더라도 Windows 전용이거나 업데이트가 부족한 경우가 많습니다.

3. 오디오 처리 기능의 부족

많은 도구가 비디오의 영상 부분만 처리하고 오디오는 고려하지 않는 경우가 많습니다. 따라서 사용자는 FFmpeg 등의 도구를 이용해 오디오를 따로 추출하고 다시 합치는 과정을 직접 수행해야 합니다. 이는 전체 워크플로우를 더욱 복잡하게 만들고, 싱크가 어긋나는 등의 오류 발생 가능성을 높입니다.

4. 제한적인 지원 및 문서화

이러한 도구들은 개인 프로젝트나 연구용 데모로 개발되는 경우가 많아 공식적인 지원 채널이 부족한 경우가 대부분입니다. 문서도 일관되지 않거나 오래된 정보이거나 초보자에게 지나치게 기술적인 경우가 많습니다. 문제가 발생하면 GitHub 이슈, Reddit 스레드, 포럼 등을 직접 찾아 해결해야 하며, 명확한 답을 얻기 어려운 경우도 많습니다.

오픈 소스 비디오 업스케일러의 더 간단하고 효율적인 대안

오픈 소스 AI 업스케일러를 설정하는 데 어려움을 겪어본 적이 있다면, 당신만 그런 것이 아닙니다. Python 환경 설치부터 모델 파일 관리, 영상과 오디오 재조합까지, 단순한 화질 개선 작업이 하루 이상 걸리는 프로젝트처럼 변하는 경우가 많습니다.

이 전체 과정을 단순화하기 위해 Aiarty Video Enhancer는 코딩, 명령줄, 복잡한 설정 없이 사용할 수 있는 올인원 비디오 업스케일링 및 복원 솔루션을 제공합니다.

Aiarty를 사용하면 저해상도 영상을 단 몇 번의 클릭만으로 1080p, 2K, 또는 4K로 업스케일할 수 있습니다. 단순한 해상도 향상을 넘어, 압축 노이즈 제거, 디블러링, 얼굴 디테일 복원까지 지원하며 오래된 DV 영상부터 스마트폰 촬영 영상까지 품질을 개선할 수 있습니다. 또한 끊기는 영상에는 프레임 보간 기능을 통해 더 부드러운 재생 효과를 제공합니다.

기능 비교: Aiarty Video Enhancer vs. 오픈 소스 비디오 업스케일러

Anime4K는 잘 알려진 오픈 소스 프로젝트이지만, 사전 처리 및 영상 내보내기 중심의 업스케일링 도구라기보다는 실시간 재생 향상에 초점이 맞춰져 있습니다. 따라서 본 비교에서는 해당 도구를 제외했으며, AI 기반 비디오 업스케일링 및 향상(프리프로세싱 기반) 기능을 제공하는 도구들만 비교 대상으로 포함했습니다.

아래는 Aiarty Video Enhancer와 가장 일반적으로 사용되는 오픈 소스 옵션들의 비교입니다:

Aiarty Video Enhancer를 사용하여 비디오 업스케일/향상하는 방법

Aiarty Video Enhancer는 처음 사용하는 사람도 쉽게 시작할 수 있도록 설계되어 있으며, 별도의 영상 편집 지식이 필요하지 않습니다. 아래의 간단한 단계만 따라 하면 손쉽게 비디오를 향상시킬 수 있습니다:

Step 1: Aiarty Video Enhancer 다운로드 및 설치

아래 버튼을 클릭하여 PC 또는 Mac에 Aiarty Video Enhancer를 다운로드하고 설치하세요. 설치 과정은 매우 간단하며 추가적인 의존성이나 환경 설정이 필요하지 않습니다.

Step 2: 비디오 가져오기

프로그램을 실행한 뒤, 비디오 파일을 메인 작업 공간으로 드래그하세요.

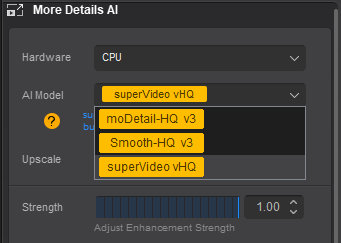

Step 3: 영상에 맞는 AI 모델 선택

Aiarty는 다양한 상황에 맞춘 전용 모델을 제공합니다. AI Model 드롭다운에서 선택하세요:

- More Detail-HQ v3: 디테일이 많은 영상에 적합합니다. 질감을 선명하게 강화하면서도 자연스러운 색감을 유지합니다.

- Smooth-HQ v3: 노이즈와 결점을 부드럽게 정리해 과하지 않은 깔끔한 결과를 만들어줍니다.

- SuperVideo vHQ: 저조도 또는 어두운 영상에 적합하며, 강한 노이즈를 제거하고 숨겨진 디테일을 복원합니다.

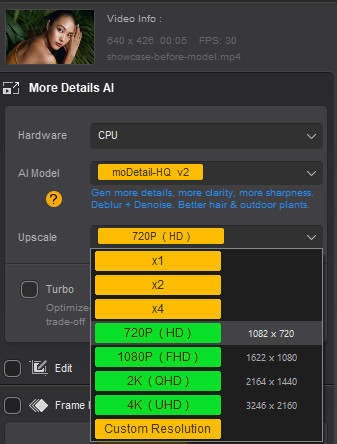

Step 4: 원하는 업스케일 옵션 선택

Upscale 메뉴에서 영상과 목적에 맞는 해상도를 선택하세요.

Tips:

- 많은 영상에서는 ×4 또는 4K와 같이 높은 옵션을 선택하면 선명도와 디테일이 즉각적으로 향상됩니다.

- 하지만 경우에 따라 ×4나 4K로 바로 올리는 것보다 ×2 업스케일 후 다시 ×2를 적용하는 단계적 업스케일링이 더 깨끗하고 안정적인 결과를 만들 수 있습니다. 특히 압축이 심하거나 오래된 영상에서 효과적입니다.

- 소스 영상이 이미 고해상도이고 주로 노이즈 감소나 약간의 블러 보정이 목적이라면 ×1을 선택하면 해상도를 늘리지 않고도 화질을 개선할 수 있습니다.

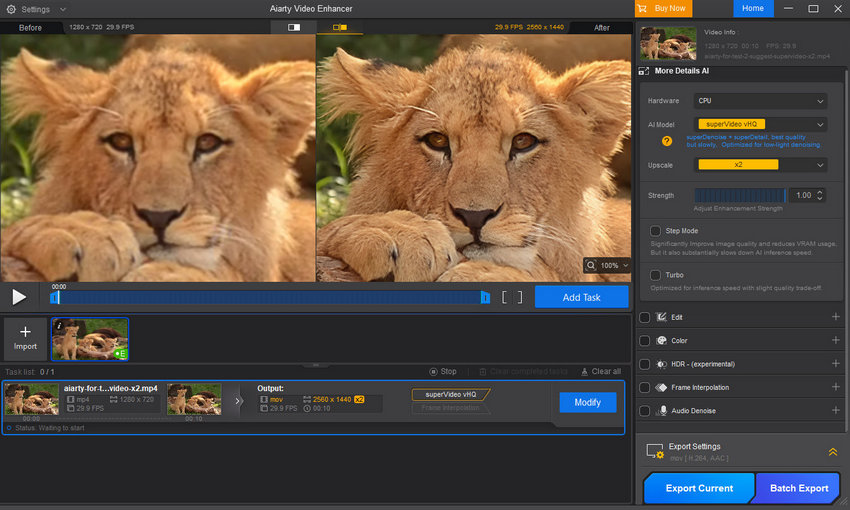

Step 5: 결과 미리보기 및 필요 시 미세 조정

Preview 버튼을 클릭하면 내보내기 전에 향상된 영상이 어떻게 보일지 짧게 확인할 수 있습니다.

테스트에서는 1920x1080에서 3840x2160으로 2x 업스케일링을 선택했습니다. 아래 스크린샷에서 보듯이, 원본 영상의 노이즈가 완전히 제거되어 매우 깨끗한 프리뷰 결과를 확인할 수 있었습니다.

If the preview doesn’t meet your expectations, you can refine the result using the following adjustments:

- 영상 유형에 더 잘 맞는 다른 AI 모델로 전환합니다.

- 한 번에 크게 올리는 방식 대신 단계별 업스케일링을 사용해 다른 해상도 옵션을 시도합니다.

- 이미지가 과하게 샤프하거나 부자연스럽게 보일 경우 향상 강도를 낮춥니다.

- Step Mode를 활성화하면 시각적 품질을 추가로 개선할 수 있으며 VRAM 사용량을 크게 줄일 수 있습니다 (단, AI 처리 속도는 느려질 수 있습니다).

- 필요한 경우 Color 패널을 확장하여 Restore Color를 활성화하거나 색온도, 색조, 노출, 대비 등의 파라미터를 미세 조정합니다.

Step 6: 향상된 영상 내보내기

미리보기가 만족스럽다면 작업을 큐에 추가한 뒤, 단일 영상은 "Export Current"를 선택하고 여러 영상은 "Batch Export"로 한 번에 처리할 수 있습니다.

아래는 Aiarty Video Enhancer의 업스케일링 및 영상 향상 성능을 보여주는 추가 예시입니다.

예시 1: 원본은 노이즈와 컬러 노이즈가 심한 오래된 영상입니다. 향상 후에는 전반적인 선명도가 눈에 띄게 개선되었습니다.

예시 2: 1190x724 해상도의 애니메이션 영상이 2380x1448로 성공적으로 업스케일되었으며, 선명한 라인과 감소된 아티팩트가 확인됩니다.

결론

오픈소스 AI 비디오 업스케일러와 향상 도구는 비용을 들이지 않고도 영상 화질을 개선할 수 있는 흥미로운 가능성을 제공합니다. 하지만 앞서 살펴본 것처럼, 기술적인 허들, 복잡한 설치 과정, 그리고 제한적인 사용자 친화 기능 때문에 많은 사용자들이 속도 저하나 불편함을 겪기도 합니다.

보다 간단하고 스트레스 없이 영상을 업스케일링하고 향상시키고 싶은 사용자에게는 Aiarty Video Enhancer와 같은 도구가 강력하면서도 접근하기 쉬운 대안이 될 수 있습니다. 직관적인 인터페이스, 다양한 기능, 안정적인 성능을 통해 고급 AI 기술과 실사용 편의성 사이의 간극을 효과적으로 메워줍니다.

오래된 가족 영상 복원, 스마트폰 영상 보정, 혹은 소셜 미디어용으로 더 선명한 콘텐츠를 만들고 싶을 때 어떤 도구를 선택하느냐에 따라 결과는 크게 달라집니다. 이 가이드가 보다 적절한 선택을 하는 데 도움이 되기를 바랍니다.

자주 묻는 질문 (FAQs)

자주 묻는 질문 (FAQs)

최고의 오픈소스 AI 비디오 업스케일러는 사용 목적과 기술 숙련도에 따라 달라집니다. Video2X, Real-ESRGAN, Waifu2x와 같은 도구들이 GitHub에서 가장 널리 사용되는 대표적인 옵션입니다. 특히 Video2X는 여러 AI 모델을 지원하고 영상의 디테일 복원 성능이 좋아 가장 강력한 솔루션 중 하나로 평가받습니다.

네, 일부 오픈소스 AI 비디오 업스케일러는 그래픽 사용자 인터페이스(GUI)를 제공합니다. 다만 여전히 많은 프로젝트는 명령어 기반으로 동작합니다. 예를 들어 Video2X는 GUI 버전을 제공하여 명령어 입력 없이도 업스케일링이 가능합니다. 또한 Real-ESRGAN이나 Waifu2x에도 커뮤니티 기반 GUI가 있어 작업을 더 쉽게 만들어줍니다.

하지만 오픈소스 GUI 버전은 여전히 의존성 설치나 추가 라이브러리 설정이 필요한 경우가 많아, 상용 영상 향상 소프트웨어만큼 간단하지 않을 수 있습니다.

네, 여러 무료 AI 비디오 업스케일러가 존재합니다. Video2X와 Waifu2x 같은 오픈소스 도구는 비용 없이 AI 기반 영상 업스케일링을 제공합니다. 이러한 도구는 해상도 향상, 노이즈 감소, 디테일 개선 등에 효과적이며 GPU와 함께 사용할 경우 성능이 더 좋아집니다.

또한 일부 상용 AI 영상 개선 소프트웨어는 무료 체험판이나 제한된 무료 버전을 제공하기도 하며, 오픈소스보다 더 간단한 설치 과정과 빠른 처리 속도를 제공하는 경우도 있습니다.

네, 가능합니다. Video2X, chaiNNer, Waifu2x Extension GUI 같은 오픈소스 도구들은 비용 없이 전문가 수준의 AI 업스케일링을 제공합니다. 이러한 도구들은 Real-ESRGAN과 같은 강력한 모델을 활용해 1080p 영상을 4K 이상으로 확대할 수 있지만, 상용 소프트웨어보다 설정 과정이 더 복잡할 수 있습니다.

많은 무료 오픈소스 영상 향상 도구는 압축 아티팩트 제거를 목표로 설계되어 있습니다. Real-ESRGAN과 SeedVR2 같은 모델은 딥러닝을 활용해 손실된 디테일을 복원하고, 압축으로 인해 발생한 픽셀 깨짐이나 블록 현상을 완화하여 전체적인 화질을 크게 개선합니다.