5 meilleurs upscalers/améliorateurs vidéo AI gratuits et open-source pour Windows/Mac/Linux

Tout le monde n’a pas le budget pour des améliorateurs vidéo AI haut de gamme. Si vous avez déjà parcouru Reddit, GitHub ou des forums de montage vidéo, vous êtes probablement tombé sur des questions similaires : "Existe-t-il de bons outils AI open-source capables d’upscaler ou d’améliorer des vidéos ?"

Alors que les options commerciales sont souvent puissantes et soignées, quelques projets open-source ont également attiré l’attention en proposant des fonctionnalités AI comme l’upscaling, le défloutage et la réduction du bruit — le tout sans coût. Certains sont spécialement conçus pour le contenu anime, tandis que d’autres visent l’amélioration vidéo générale. Mais sont-ils vraiment efficaces en pratique ? Et quels compromis impliquent leur utilisation ?

Cet article vous présente certains des upscalers et améliorateurs vidéo AI open-source gratuits les plus populaires actuellement, en expliquant leurs points forts, leurs limites, et ce à quoi s’attendre lors de l’installation et de l’utilisation.

Upscalers/Améliorateurs vidéo AI open-source gratuits populaires

Il existe de nombreux outils open-source qui prétendent améliorer ou upscaler les vidéos grâce à l'IA. Certains sont créés par des chercheurs et maintenus par des contributeurs GitHub, tandis que d'autres sont peaufinés par des développeurs indépendants pour un usage quotidien pratique.

Voici quelques-uns des upscalers et améliorateurs vidéo open-source gratuits les plus populaires. Chacun a ses points forts, ses limites et ses particularités à connaître avant de se lancer.

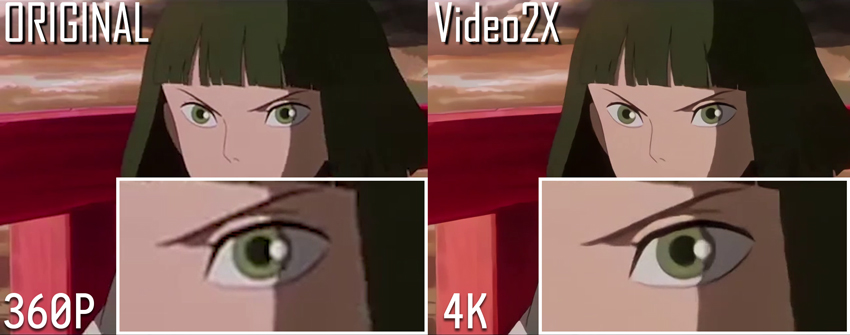

Video2X

Plateformes supportées : Windows (pleinement supporté), Linux (support limité)

Video2X est un outil open-source populaire qui upscale les vidéos en extrayant chaque image, en les agrandissant via des upscalers d'images AI, puis en reconstituant une vidéo haute résolution avec ces images traitées.

Le processus comporte plusieurs étapes :

- Extraction des images : Video2X utilise d'abord FFmpeg pour découper la vidéo en images individuelles et un fichier audio.

- Upscaling des images : Chaque image est upscalée avec un modèle AI supporté comme waifu2x, SRMD ou Anime4KCPP. Les modèles sont personnalisables selon le type de contenu (anime vs vidéo réelle).

- Reconstruction de la vidéo : Après traitement, FFmpeg réassemble les images upscalées et l'audio original pour créer la vidéo finale en haute résolution.

Le processus peut être lent, surtout pour de longues vidéos ou sans accélération GPU.

Les utilisateurs avancés à l'aise avec le scripting peuvent automatiser ce processus avec un simple script batch ou bash pour plus de personnalisation.

Une interface graphique simple est disponible pour Windows, tandis que Linux nécessite la ligne de commande.

- Supporte plusieurs modèles AI pour différents types de contenu

- Interface Windows simplifiant l'utilisation pour les non-techniciens

- Traitement par lot possible pour longues vidéos ou dossiers complets

- Gratuit et open-source, sans restrictions ni filigranes

- Processus lent sans GPU ; GPU NVIDIA fortement recommandé

- L'audio n'est pas traité avec la vidéo et doit être réintégré séparément

- L'installation et la configuration des modèles peuvent être complexes pour les débutants

- Support Linux limité et configuration manuelle requise

- Non compatible nativement avec macOS

Installation et utilisation :

1. Compiler le projet Video2X sur votre ordinateur

- Instructions pour Windows : https://docs.video2x.org/building/windows.html

- Instructions pour Qt6 GUI sur Windows : https://docs.video2x.org/building/windows-qt6.html

- Instructions pour Linux : https://docs.video2x.org/building/linux.html

2. Télécharger et installer Video2X

Configuration minimale requise :

CPU

- Les binaires précompilés nécessitent des CPU avec support AVX2.

- Intel : Haswell (Q2 2013) ou plus récent

- AMD : Excavator (Q2 2015) ou plus récent

GPU

- GPU compatible Vulkan

- NVIDIA : Kepler (GTX 600, Q2 2012) ou plus récent

- AMD : GCN 1.0 (Radeon HD 7000, Q1 2012) ou plus récent

- Intel : HD Graphics 4000 (Q2 2012) ou plus récent

Astuce : Sans GPU puissant, vous pouvez utiliser Video2X gratuitement sur Google Colab avec accès à des GPU performants comme NVIDIA T4, L4 ou A100 pendant 12 heures par session.

Installation sur Windows (version ligne de commande)

Téléchargez la dernière version précompilée depuis GitHub et installez-la dans votre répertoire utilisateur :

Une fois extrait, ajoutez %LOCALAPPDATA%\Programs\video2x aux variables d'environnement pour un accès facile.

Installation Windows Qt6 GUI

Téléchargez l'installateur video2x-qt6-windows-amd64-installer.exe depuis la page des releases et double-cliquez pour lancer l'installation. Le wizard vous guidera, y compris la création d’un raccourci bureau.

Installation sur Linux

Suivez le guide officiel : Installation Linux Video2X.

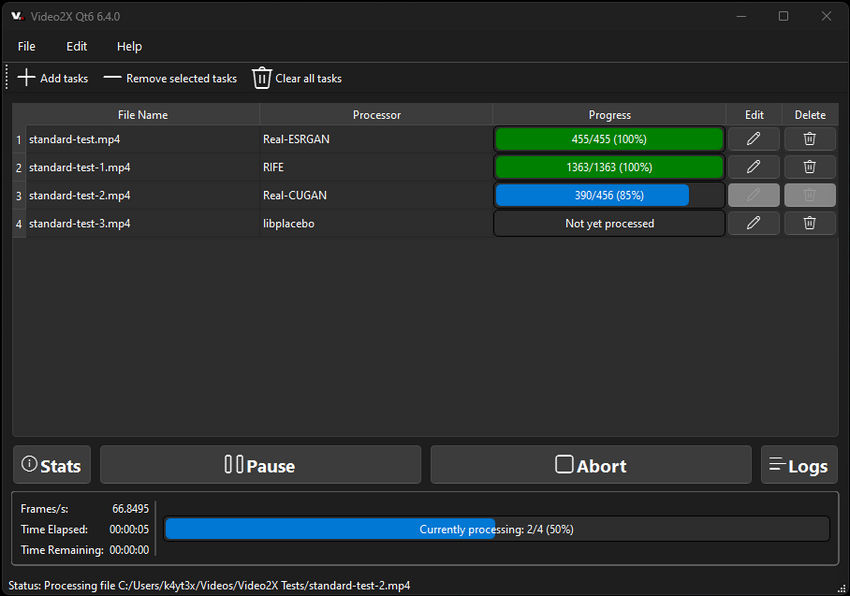

3. Lancer Video2X

Via ligne de commande ou GUI (Windows). Consultez la documentation CLI pour définir chemins d'entrée/sortie, modèles AI, options de sortie, etc.

Exemple de commande :

Pour le GUI, lancez Video2X Qt6, chargez la vidéo, configurez GPU, mode traitement et filtres, puis cliquez sur Run.

Real-ESRGAN

Plateformes supportées : Windows, Linux, macOS

Real-ESRGAN est un outil open-source gratuit largement utilisé pour l’upscaling d’images et de vidéos développé par l’équipe derrière ESRGAN. Basé sur PyTorch, il propose un upscaling haute qualité grâce à des réseaux antagonistes génératifs (GAN) pré-entraînés. Bien qu’originellement conçu pour la super-résolution d’images uniques, Real-ESRGAN peut aussi traiter les vidéos image par image, ce qui en fait un choix solide pour restaurer des vidéos basse résolution ou compressées.

Il excelle particulièrement sur des scènes réelles — paysages, visages ou vidéos de smartphones de faible qualité — et est reconnu pour sa capacité à restaurer les détails fins tout en réduisant le bruit et les artefacts de compression.

- Qualité d’amélioration d’image de pointe, surtout pour les photos et vidéos réelles

- Plusieurs modèles pré-entraînés disponibles (général, anime, restauration de visage, etc.)

- Maintenu activement par une équipe de recherche solide

- Peut être scripté ou intégré dans des flux vidéo personnalisés

- Pas d’interface graphique intégrée ; nécessite l’usage de la ligne de commande ou du scripting

- Extraction et recombinaison des images nécessaires pour les vidéos (non automatisé)

- Exige un environnement Python et des notions de PyTorch

- Traitement lent sur CPU ; GPU fortement recommandé

Installation & Utilisation :

1. Installer Python et les dépendances

- Assurez-vous que Python 3.7 ou supérieur est installé

- Cloner le dépôt :

- Installer les packages requis :

cd Real-ESRGAN

pip install basicsr

pip install facexlib

pip install gfpgan

pip install -r requirements.txt

python setup.py develop

2. Télécharger les modèles pré-entraînés

- RealESRGAN_x4plus (usage général)

- RealESRGAN_x4plus_anime_6B (images anime)

- realesr-general-x4v3 (images compressées)

Téléchargez les fichiers .pth souhaités depuis les releases GitHub ou les liens fournis.

3. Préparer la vidéo (extraction des images)

Utilisez FFmpeg pour extraire les images :

4. Lancer Real-ESRGAN sur les images extraites

Exemple de commande (upscaling 4x) :

5. Recombiné les images en vidéo

Encore avec FFmpeg :

6. (Optionnel) Ajouter l’audio original

Real-ESRGAN est idéal pour les utilisateurs à l’aise avec Python et la ligne de commande, ou souhaitant intégrer un upscaling de haute qualité dans des pipelines automatisés. Bien que plus technique à configurer que les options GUI, les résultats visuels sont souvent impressionnants, surtout pour restaurer les détails de vidéos floues ou basse résolution.

Astuce : Comme Video2X, Real-ESRGAN peut aussi tourner sur Google Colab. Consultez cette vidéo pour voir comment utiliser Colab pour upscaler vos vidéos en HD ou 4K sans GPU local puissant.

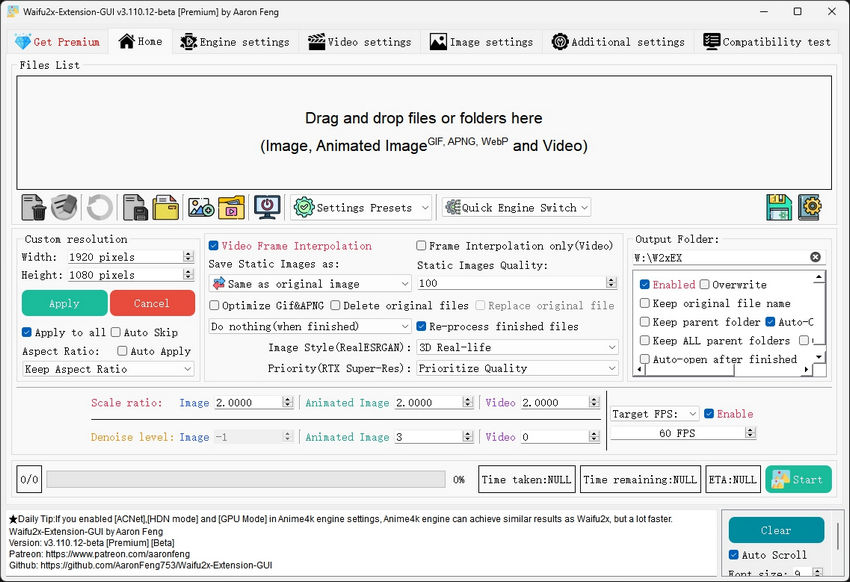

Waifu2x Extension GUI

Plateforme supportée : Windows

Waifu2x Extension GUI est une application de bureau conviviale, uniquement pour Windows, qui regroupe plusieurs upscalers AI — y compris waifu2x, Real-ESRGAN et Anime4K — dans une interface graphique unique. Initialement conçue pour les images et vidéos de style anime, elle prend désormais en charge les contenus réels avec des options de modèles supplémentaires. Elle est très appréciée pour sa facilité d’installation et d’utilisation, sans besoin de ligne de commande.

Contrairement à beaucoup d’outils open-source, Waifu2x Extension GUI mise sur la commodité : elle gère l’extraction des images, l’upscaling, la reconstruction vidéo et même la synchronisation audio — le tout dans la même interface. C’est donc l’une des options les plus accessibles pour l’amélioration vidéo basée sur l’IA sur Windows.

- GUI tout-en-un supportant l’upscaling d’images, GIF et vidéos

- Plusieurs backends AI inclus (waifu2x-ncnn-vulkan, Real-ESRGAN, Anime4K, SRMD)

- Support intégré pour le muxing vidéo/audio — pas besoin de FFmpeg en ligne de commande

- Traitement par lot et paramètres avancés pour utilisateurs expérimentés

- Pas besoin de Python ni de dépendances externes

- Uniquement Windows — pas de support macOS ou Linux

- Traitement lent sur GPU bas de gamme

- Options de modèles et fréquence de mises à jour dépendantes du développeur

- Installateur un peu lourd (~1,5 Go à cause des modèles et dépendances inclus)

Installation & Utilisation :

1. Télécharger l’installateur

Rendez-vous sur la page GitHub ou Gitee du projet : https://github.com/AaronFeng753/Waifu2x-Extension-GUI. Choisissez la dernière version .exe (ex : Waifu2x-Extension-GUI-v...-Installer.exe).

2. Installer et lancer le programme

Exécutez l’installateur. Une fois terminé, ouvrez l’application depuis le raccourci bureau ou le menu Démarrer.

3. Charger votre vidéo

Glissez-déposez votre fichier vidéo dans le programme ou cliquez sur « Ajouter des fichiers » et sélectionnez votre vidéo.

4. Choisir les paramètres d’upscaling

- Sélectionner le modèle AI (ex : Real-ESRGAN, waifu2x-ncnn-vulkan, ou Anime4KCPP)

- Définir le multiplicateur de résolution de sortie (ex : 2× ou 4×)

- Optionnel : appliquer débruitage, interpolation d’images ou réduction des artefacts

5. Lancer le traitement

Cliquez sur le bouton « Start ». L’application gère tout automatiquement : extraction des images, upscaling, reconstruction de la vidéo et synchronisation audio.

6. Accéder au résultat

La vidéo upscalée sera enregistrée dans le dossier de sortie spécifié, prête à être utilisée ou uploadée.

Waifu2x Extension GUI est idéal pour les utilisateurs souhaitant un résultat solide de upscaling AI sans toucher au code ni configurer des environnements complexes. Moins personnalisable que les outils basés sur scripts, il offre néanmoins une expérience clé en main très aboutie — surtout pour l’anime et les vidéos web basse résolution.

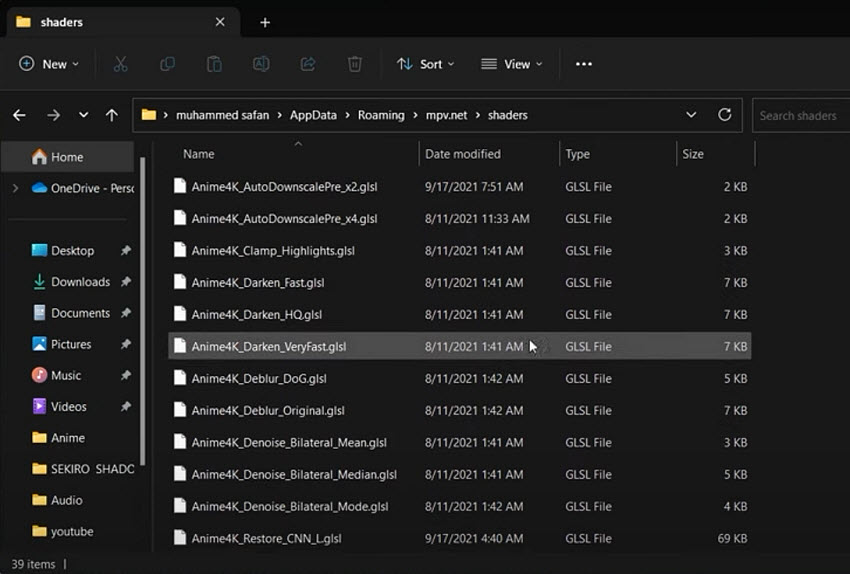

Anime4K

Plateformes supportées : Windows, macOS, Linux (via lecteurs vidéo ou scripts personnalisés)

Anime4K est un algorithme d’upscaling vidéo léger et open-source, conçu spécifiquement pour le contenu anime et line-art. Contrairement aux autres outils basés sur deep learning ou GAN, Anime4K utilise des shaders OpenCL ou Vulkan efficaces qui s’exécutent directement sur le GPU, offrant un traitement rapide et en temps réel, même sur des machines peu puissantes.

Plutôt que d’extraire et de recomposer les images vidéo, Anime4K est généralement utilisé dans des lecteurs vidéo comme MPV ou VLC via des scripts shaders. Il peut aussi être appliqué hors ligne avec des filtres FFmpeg ou outils en ligne de commande, mais sa force principale réside dans l’amélioration en lecture temps réel — rendant les anciens anime ou vidéos web basse résolution plus nettes instantanément.

- Amélioration en temps réel avec presque aucun décalage

- Très léger — fonctionne sur GPU intégrés

- Parfait pour anime, dessins animés et contenu style line-art

- Fonctionne dans MPV, VLC ou avec scripts personnalisés — pas besoin d’extraire les images

- Support multi-plateforme

- Non adapté aux vidéos photographiques ou réelles

- Pas d’interface graphique ni d’installateur packagé

- Configuration manuelle nécessaire pour l’intégration aux lecteurs vidéo

- Qualité de sortie moins nette que les upscalers basés sur deep learning

Installation & Utilisation :

Option 1 : Lecture temps réel avec MPV

- Téléchargez le lecteur MPV depuis : https://mpv.io/

- Clonez ou téléchargez le dépôt Anime4K : https://github.com/bloc97/Anime4K

- Placez les fichiers shader (ex : Anime4K_Clamp_Hybrid.glsl) dans le dossier shaders de MPV.

- Éditez mpv.conf pour activer le shader : glsl-shaders="~~/shaders/Anime4K_Clamp_Hybrid.glsl"

- Ouvrez votre vidéo avec MPV et l’amélioration s’appliquera en temps réel.

Option 2 : Traitement hors ligne avec FFmpeg (utilisateurs avancés)

Certains forks (comme Anime4KCPP) permettent d’appliquer Anime4K directement sur des fichiers vidéo, mais cela nécessite de compiler l’outil ou d’utiliser des builds FFmpeg spécifiques avec support shader — pas adapté aux débutants.

Anime4K est idéal pour les fans d’anime ou ceux cherchant une amélioration visuelle instantanée pour du contenu animé basse résolution. Il n’offre pas la restauration profonde des modèles IA comme Real-ESRGAN ou Video2X, mais sa rapidité et sa simplicité en font un excellent choix pour la lecture ou l’amélioration légère.

Comme vous pouvez le voir, les améliorateurs vidéo open-source se présentent sous différentes formes — des GUI conviviales comme Waifu2x Extension GUI aux solutions légères basées sur shaders comme Anime4K.

Bien que ces outils soient puissants et gratuits, ils impliquent certains compromis qui peuvent être frustrants pour les débutants ou même les utilisateurs expérimentés.

Dans la section suivante, nous examinerons les difficultés les plus courantes rencontrées avec ces solutions open-source.

REAL Video Enhancer

Plateformes supportées : Windows, Linux, macOS

REAL Video Enhancer est une application de bureau tout-en-un conçue pour l’amélioration vidéo via IA, incluant l’interpolation d’images et l’upscaling. Elle a été créée comme une alternative moderne et multiplateforme aux logiciels plus anciens comme Flowframes, offrant une expérience conviviale sans nécessiter de connaissances en ligne de commande.

L’application utilise des modèles IA de pointe, tels que RIFE pour l’interpolation vidéo et Real-ESRGAN pour l’upscaling. Elle exploite des moteurs d’inférence hautement optimisés comme TensorRT et NCNN pour maximiser les performances, notamment sur les GPU modernes. Contrairement à de nombreux outils GUI, REAL Video Enhancer prend en charge tous les principaux systèmes d’exploitation de bureau, en faisant un choix polyvalent pour un large éventail d’utilisateurs.

- Support multiplateforme : disponible sur Windows, Linux et macOS.

- Haute optimisation grâce aux backends TensorRT et NCNN pour des performances supérieures sur le matériel compatible.

- Fonctionnalités complètes intégrant interpolation d’images (RIFE), upscaling (Real-ESRGAN) et décompression vidéo dans une interface unique.

- GUI conviviale offrant une interface simple et intuitive pour un flux de travail direct.

- Fonctionnalités avancées incluses comme l’intégration Discord RPC, la détection de changement de scène et un aperçu en temps réel des images rendues.

- Exigeant en ressources : nécessite un GPU puissant avec au moins 8 Go de VRAM et 16 Go de RAM pour des performances optimales.

- Taille de téléchargement importante, la version TensorRT pouvant atteindre 16 Go à cause des modèles et dépendances inclus.

- Exigences matérielles spécifiques, car les performances optimales dépendent de GPU et systèmes d’exploitation supportant pleinement le backend TensorRT.

Installation & Utilisation

1. Télécharger l’application

Rendez-vous sur la page officielle GitHub du projet : https://github.com/TNTwise/REAL-Video-Enhancer/releases/tag/RVE-2.3.6.

Téléchargez la version appropriée pour votre système d’exploitation (Windows .exe, Linux .flatpak, ou macOS .dmg).

2. Installer et lancer

Exécutez l’installateur téléchargé. Suivez les instructions pour terminer l’installation. Une fois terminé, lancez l’application depuis votre bureau ou le dossier Applications.

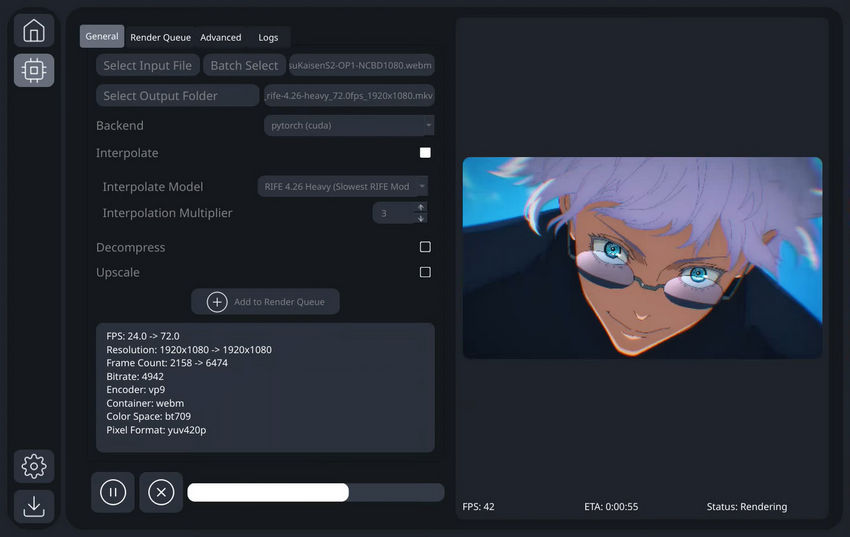

3. Charger votre vidéo

Dans l’onglet « Général », cliquez sur « Sélectionner le fichier d’entrée » ou « Sélection par lot » pour importer la ou les vidéos que vous souhaitez traiter.

4. Configurer les paramètres de traitement

- Backend : choisissez un backend approprié, par exemple pytorch (cuda), pour exploiter la puissance de votre GPU.

- Interpolation : cochez cette case pour activer l’interpolation d’images.

- Modèle d’interpolation : sélectionnez un modèle pour l’interpolation, comme RIFE 4.26 Heavy.

- Multiplicateur d’interpolation : définissez le facteur d’interpolation, par exemple 3, ce qui triplera le nombre d’images par seconde de la vidéo.

- Décompression : cochez cette case pour décompresser la vidéo.

- Upscale : cochez cette case pour activer l’upscaling et sélectionnez le modèle correspondant.

5. Ajouter à la file de rendu

Une fois tous les paramètres configurés, cliquez sur « Ajouter à la file de rendu ». Vous pouvez ensuite gérer vos tâches en attente dans l’onglet « File de rendu ».

6. Lancer le traitement

Cliquez sur le bouton play (►) en bas pour démarrer le traitement.

Le GUI intuitif de REAL Video Enhancer simplifie les opérations complexes d’amélioration vidéo, permettant même aux débutants de démarrer facilement.

Difficultés courantes lors de l’utilisation des upscalers vidéo AI open-source

Bien que les upscalers vidéo AI open-source offrent des capacités impressionnantes, ils présentent souvent une courbe d’apprentissage abrupte. De nombreux utilisateurs téléchargent ces outils en s’attendant à une expérience plug-and-play, pour découvrir que leur utilisation nécessite des étapes techniques, la gestion des dépendances ou des heures de tâtonnements. Voici quelques-unes des difficultés les plus courantes rencontrées.

1. Installation et configuration complexes

Beaucoup d’upscalers vidéo AI open-source reposent sur Python, PyTorch ou d’autres frameworks nécessitant une installation manuelle. Vous devrez peut-être cloner des dépôts GitHub, installer des dépendances, configurer des variables d’environnement ou télécharger des modèles AI séparés — avant même de traiter une seule vidéo. Si vous n’êtes pas déjà familier avec ces outils, le processus peut sembler intimidant.

2. Absence d’interface unifiée

Contrairement aux outils commerciaux, qui proposent généralement des interfaces polies et des workflows simplifiés, la plupart des projets open-source se concentrent sur la fonctionnalité AI en arrière-plan. Il faut souvent extraire les images vidéo avec FFmpeg, les upscaler séparément, puis reconstituer la vidéo manuellement. Des options GUI existent, mais elles sont souvent limitées à Windows ou obsolètes.

3. Gestion de l’audio souvent ignorée

De nombreux outils se concentrent uniquement sur l’aspect visuel de la vidéo et laissent l’audio de côté. Les utilisateurs doivent donc extraire et rattacher manuellement les pistes audio avec FFmpeg ou d’autres outils, ajoutant une étape supplémentaire à un workflow déjà complexe et augmentant le risque d’erreurs comme la désynchronisation.

4. Support et documentation limités

Étant souvent des projets passionnels ou des démonstrations de recherche, ces outils manquent généralement de canaux de support formels. La documentation peut être incohérente, obsolète ou trop technique pour les débutants. En cas de problème, il ne reste souvent que de consulter les issues GitHub, les discussions Reddit ou les forums en ligne — ce qui ne garantit pas toujours des réponses claires.

Une alternative plus simple et plus efficace aux upscalers/améliorateurs vidéo open-source

Si vous avez déjà eu du mal à faire fonctionner un upscaler AI open-source, vous n’êtes pas seul. Entre l’installation des environnements Python, la gestion des fichiers modèles et la recomposition des vidéos et audios, ce qui devrait être une tâche simple d’amélioration se transforme souvent en projet du week-end.

Pour simplifier l’ensemble du processus, Aiarty Video Enhancer propose une solution tout-en-un claire pour l’upscaling et la restauration vidéo — sans codage, sans outils en ligne de commande et sans tâtonnements techniques.

Avec Aiarty, vous pouvez améliorer des vidéos basse résolution jusqu’à 1080p, 2K ou même 4K en seulement quelques clics. Il va également au-delà de l’amélioration de la résolution : suppression des artefacts de compression, réduction du bruit, défloutage des visages et restauration des détails fins dans tout type de contenu, des anciennes cassettes DV aux vidéos filmées sur mobile. Pour les vidéos saccadées, l’interpolation d’images aide à créer un rendu plus fluide.

Comparaison des fonctionnalités : Aiarty Video Enhancer vs. Upcalers vidéo open-source

Bien qu’Anime4K soit un projet open-source bien connu, il se concentre sur l’amélioration en lecture temps réel plutôt que sur le pré-traitement et l’exportation des vidéos — ce qui le rend fondamentalement différent des autres outils évoqués. Pour cette raison, nous l’avons exclu du tableau comparatif ci-dessous, qui se concentre sur les outils conçus pour l’upscaling et l’amélioration vidéo par IA via prétraitement.

Voici comment Aiarty Video Enhancer se positionne face aux options open-source les plus utilisées :

Comment utiliser Aiarty Video Enhancer pour améliorer et upscaler vos vidéos

Commencer avec Aiarty Video Enhancer est simple et ne nécessite aucune connaissance préalable en montage vidéo. Suivez simplement ces étapes pour améliorer vos vidéos facilement :

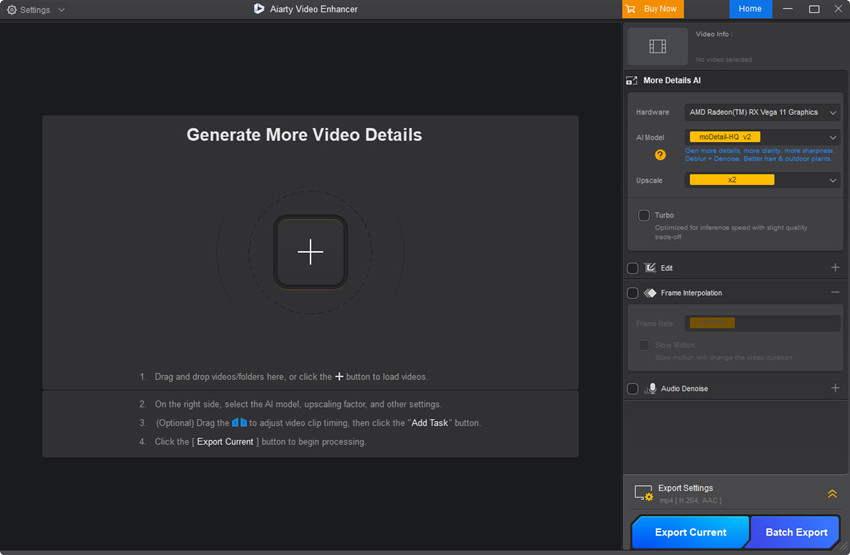

Étape 1 : Téléchargez et installez Aiarty Video Enhancer sur votre PC ou Mac depuis le site officiel.

Étape 2 : Ouvrez le programme et glissez votre fichier vidéo dans l’espace de travail principal.

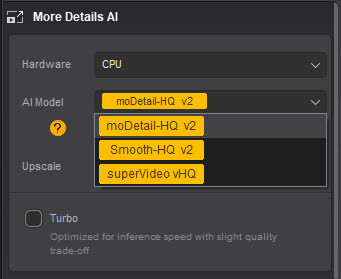

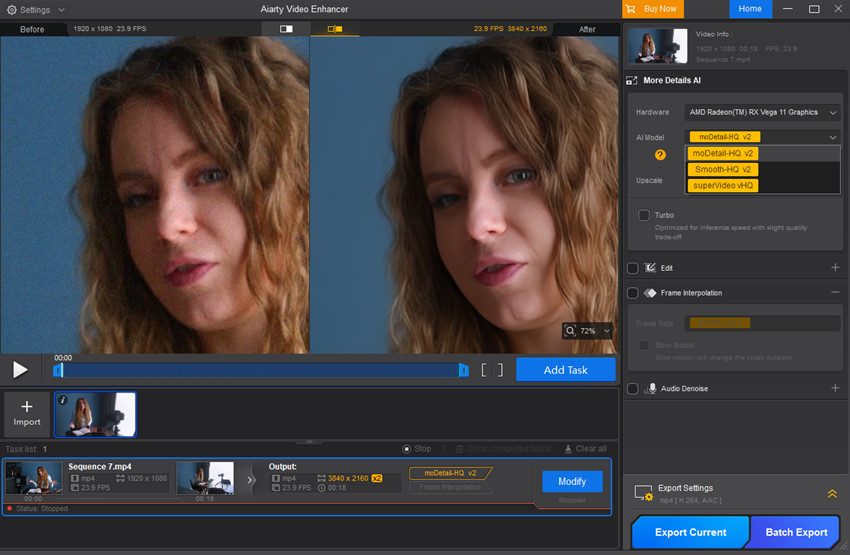

Étape 3 : Dans le menu déroulant Modèle AI, sélectionnez le modèle d’amélioration qui convient le mieux à votre type de vidéo.

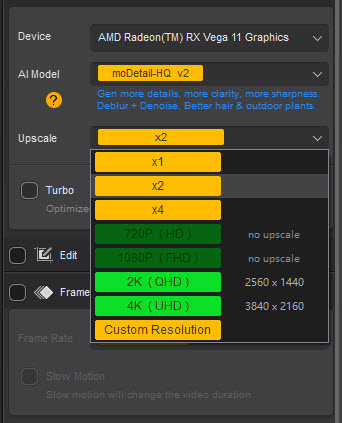

Étape 4 : Choisissez la résolution de sortie souhaitée dans le menu Upscale.

Étape 5 : Cliquez sur le bouton Aperçu pour voir un exemple rapide de l’aspect de la vidéo améliorée.

Dans mon test, j’ai choisi un upscaling 2x, passant de 1920x1080 à 3840x2160. Comme vous pouvez le voir dans la capture d’écran ci-dessous, l’aperçu vidéo est excellent — tout le bruit de l’original a été complètement supprimé.

Étape 6 : Si l’aperçu répond à vos attentes, ajoutez la tâche à la file d’attente et sélectionnez soit « Exporter l’actuel » pour une seule vidéo, soit « Exportation par lot » pour traiter plusieurs vidéos à la fois.

Voici deux autres exemples qui mettent en valeur les capacités d’Aiarty Video Enhancer pour l’upscaling et l’amélioration vidéo :

Exemple 1 : La source est un ancien clip avec beaucoup de grain et du bruit de couleur. Après amélioration, la vidéo montre une clarté notable.

Exemple 2 : Une vidéo anime en 1190x724 a été upscalée avec succès à 2380x1448, avec des lignes plus nettes et moins d’artefacts.

Si vous souhaitez suivre un tutoriel vidéo étape par étape avec davantage d’exemples, ce guide YouTube couvre tout.

Conclusion

Les upscalers et optimiseurs vidéo open source basés sur l’IA offrent des possibilités passionnantes pour améliorer la qualité des vidéos sans dépenser un centime. Cependant, comme nous l’avons vu, ils s’accompagnent souvent de difficultés techniques, d’installations complexes et de fonctionnalités limitées qui peuvent ralentir ou frustrer de nombreux utilisateurs.

Pour ceux qui recherchent une méthode plus fluide et sans tracas pour upscaler et améliorer leurs vidéos, des outils comme Aiarty Video Enhancer offrent une solution puissante et accessible. Grâce à son interface intuitive, ses fonctionnalités complètes et ses performances fiables, il comble le fossé entre la technologie IA avancée et une utilisation pratique au quotidien.

Que vous restauriez de vieilles vidéos familiales, nettoyiez des séquences tournées sur smartphone ou souhaitiez simplement un contenu plus net et plus clair pour les réseaux sociaux, le choix du bon outil fait toute la différence. Nous espérons que ce guide vous aidera à faire un choix éclairé et à tirer le meilleur parti de l’amélioration vidéo assistée par l’IA.