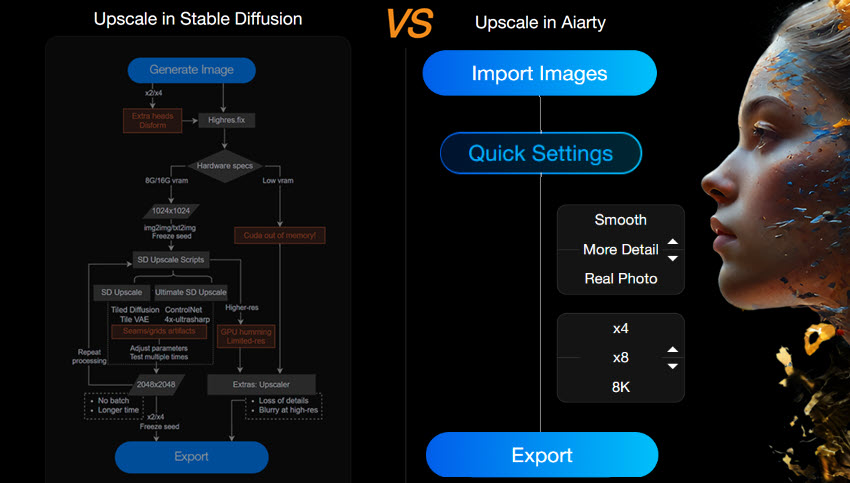

Dies ist der ultimative Leitfaden zum Hochskalieren in Stable Diffusion, inklusive Vergleichen der verschiedenen Stable Diffusion Upscaler. Neben integrierten Funktionen und Erweiterungen stellen wir auch eine eigenständige Software vor, die Bilder direkt von 512px auf 4K und höhere Auflösungen mit feinen Details skalieren kann.

Vielleicht haben Sie bereits von verschiedenen Workflows für unterschiedliche Anlässe gehört:

- - Workflow 1: txt2img, highres.fix 2X

- - Workflow 2: txt2img, highres.fix 2X, img2img 2X (Seed fixieren, niedrige Denoising Strength)

- - Workflow 3: txt2img, highres.fix 2X, SD Upscale Script 2X (+ControlNet)

- - Workflow 4: txt2img, highres.fix 2X, Ultimate SD Upscale 2X (+ControlNet)

- - Workflow 5: txt2img, highres.fix 2X, Tiled Diffusion (MultiDiffusion) 2X + Tiled VAE

- - Workflow 6: Eine der oben genannten Methoden + Extras Upscaler

In diesem Blog erfahren Sie mehr über die in den Workflows verwendeten Upscaling-Tools und Erweiterungen. Noch besser: Sie lernen einen weiteren eigenständigen KI-Bild-Upscaler namens Aiarty Image Enhancer (Methode 2) kennen, der diese komplexen Workflows ersetzen kann und dabei eine hervorragende Upscaling-Qualität liefert.

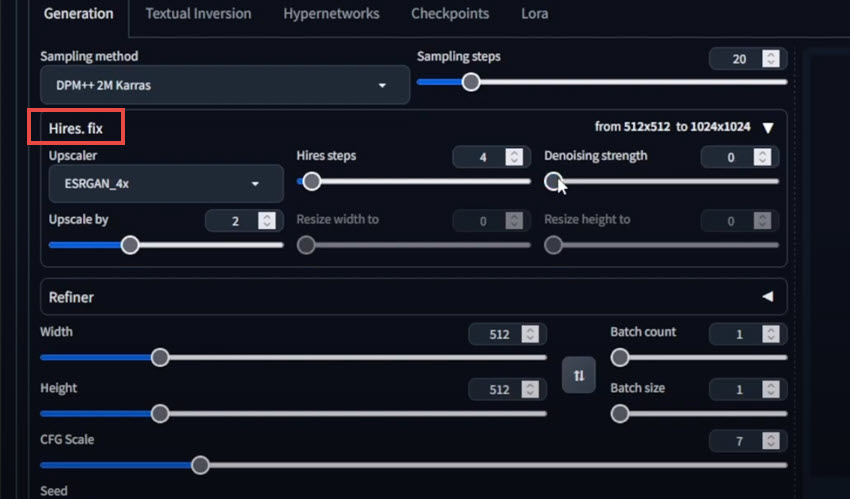

1. Highres Fix in Stable Diffusion

Die Highres.Fix-Funktion in Stable Diffusion wurde entwickelt, um zusätzliche Köpfe und Verzerrungen zu vermeiden, wenn Bilder mit einer höheren Auflösung als 512x512 generiert werden – insbesondere, wenn eine Seite länger ist als die andere.

Wenn Sie beispielsweise 512x1024 ohne aktiviertes Highres.fix generieren, sehen Sie möglicherweise zwei Köpfe oder zusätzliche Gliedmaßen im generierten Bild – es sei denn, Sie verwenden SDXL-Modelle, die mit 1024x1024 Eingaben trainiert wurden.

So nutzen Sie Highres. Fix in Stable Diffusion

Step 1. Nachdem Sie Prompts, Negative Prompts und andere notwendige Parameter in Stable Diffusion eingestellt haben, klicken Sie auf die Option "Highres.fix" unter dem Reiter "txt2img".

Step 2. Wählen Sie einen Upscaling-Algorithmus für Highres.fix aus dem Dropdown-Menü aus.

- Für allgemeine Zwecke wählen Sie R-ESRGAN 4x+

- Für Anime wählen Sie R-ESRGAN 4x+ Anime6B

Step 3. Wählen Sie den Skalierungsfaktor (Upscale by).

Wenn Ihr Quellbild beispielsweise 512x768 groß ist, ergibt ein Faktor von 2X ein Bild in 1024x1536.

Hires steps: Sie können diesen Wert auf dem Standardwert 0 lassen. Ich habe verschiedene Werte für diesen Parameter getestet, aber es ist kaum ein Unterschied feststellbar.

Denoising strength: Lassen Sie diesen Wert auf dem Standardwert 0.

Tipps:

Highres.fix ist rechenintensiv und kann zu "CUDA out of memory"-Fehlern führen. Es wird empfohlen, Highres.fix erst zu aktivieren, wenn Sie ein Bild generiert haben, das Ihnen gefällt. Sie können den Seed fixieren (freeze seed) und Highres.fix erst einschalten, nachdem Sie Ihren Lieblings-Seed gefunden haben.

2. Eigenständiger KI-Bild-Upscaler für Stable Diffusion

Bei Computern mit Grafikkarten mit geringem VRAM (z. B. 4 GB) funktioniert das Upscaling in Stable Diffusion möglicherweise nicht oder dauert ewig. Beispielsweise kann es 20 Minuten dauern, ein einzelnes Bild mit Highres.fix hochzuskalieren. Verbessern Sie Ihre Grafiken mit KI-gesteuerten Bildverbesserungstools, die Auflösung und Details erhöhen – perfekt, um mit Stable Diffusion generierte Bilder auf Profi-Niveau zu veredeln.

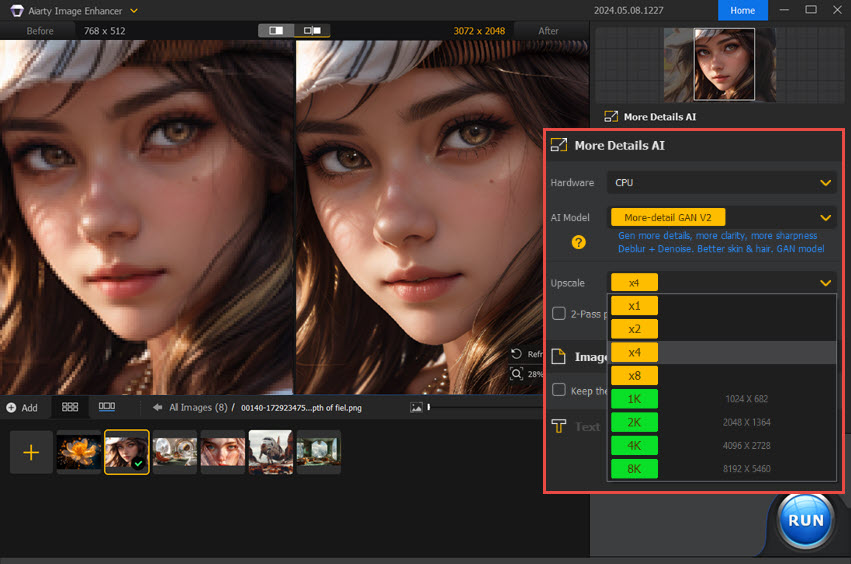

Wenn Sie 512px auf höhere Auflösungen (2K/4K/8K/16K+) auf einem durchschnittlichen Computer ohne High-End-Grafikkarte skalieren möchten, können Sie ein spezielles KI-Tool wie den Aiarty Image Enhancer von Digiarty Inc. verwenden. Er hilft Ihnen, in 3 Schritten ganz einfach Bilder in Profiqualität zu erhalten.

Aiarty Image Enhancer ist der beste Stable Diffusion Upscaler mit diesen Highlights:

- Schnellerer Prozess auf alten PCs: Skaliert 512px in 27 Sek. auf 4K (getestet mit Nvidia GTX650, 8GB RAM).

- Einfacher Batch-Workflow: Das KI-Modell kann KI-Kunst automatisch per Stapelverarbeitung analysieren und hochskalieren.

- Realistische Details: Dank eines Datensatzes von 6,78 Millionen Bildern werden beim Upscaling lebensnahe Details generiert.

- VRAM-freundlich: Aiarty ist für Nvidia/AMD/Intel/CPU optimiert und läuft bereits mit 4GB VRAM.

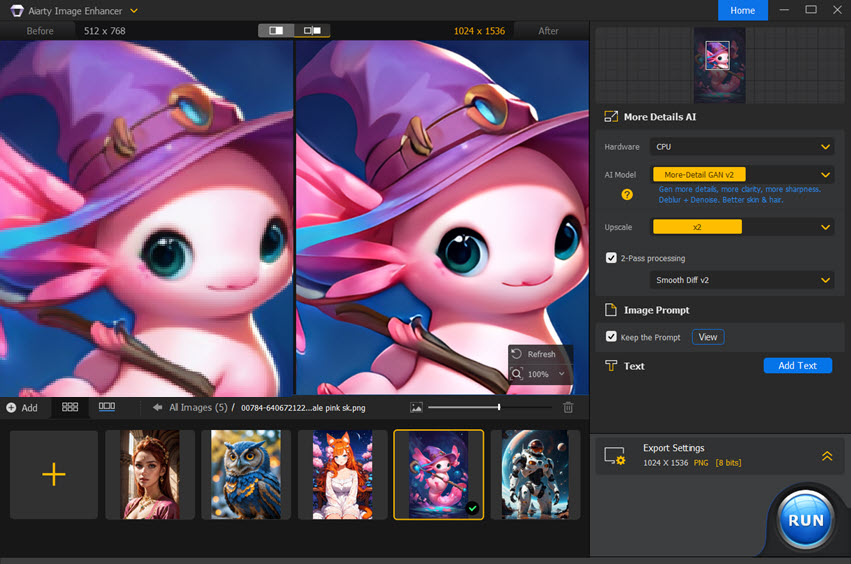

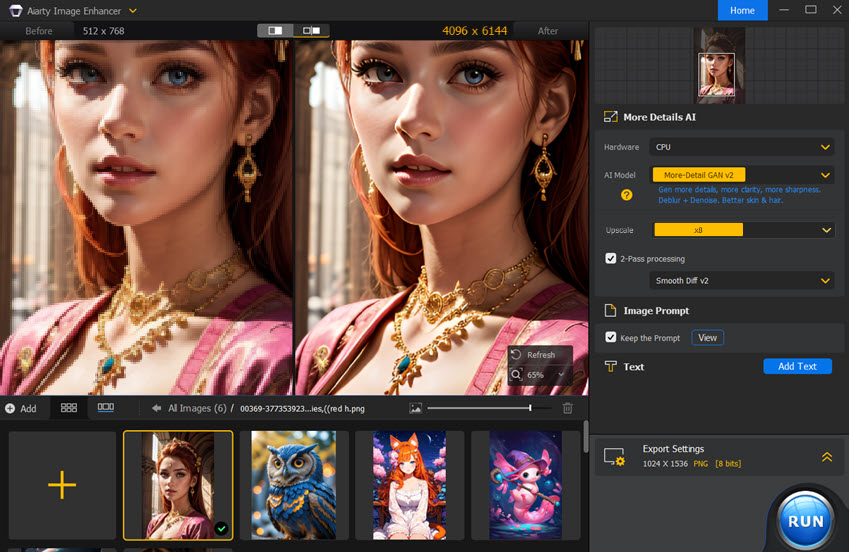

So skalieren Sie Stable Diffusion Bilder mit Aiarty Image Enhancer hoch

Nachdem Sie Aiarty Image Enhancer für Windows oder Mac heruntergeladen und installiert haben, starten Sie die Software und folgen Sie diesen Schritten.

Step 1. Importieren Sie Stable Diffusion Bilder in Aiarty Image Enhancer.

Dies funktioniert auch für andere KI-generierte Bilder, Fotos und Web-Bilder (z. B. digitale Downloads).

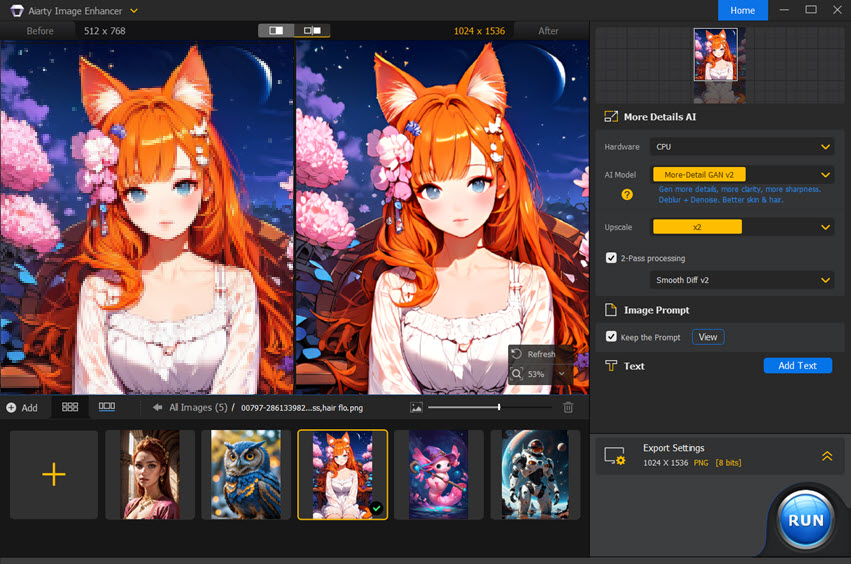

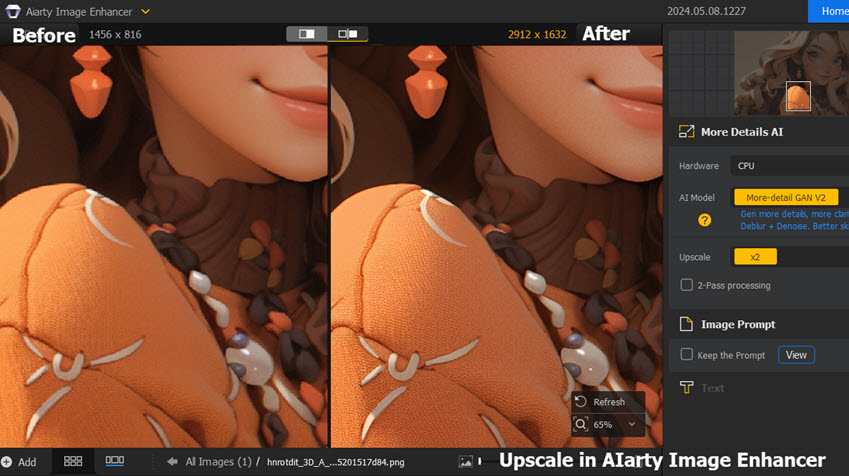

Step 2. Wählen Sie die KI-Modelle und den Skalierungsfaktor.

- More-detail Modell: Skaliert mit passenden Details hoch. Bestens geeignet für niedrig aufgelöste KI-Kunst.

- Smooth Modell: Skaliert Bilder hoch und restauriert Fehler, ohne zu viele Details hinzuzufügen.

- Photo Modell: Ideal für die Verbesserung von Fotoqualität.

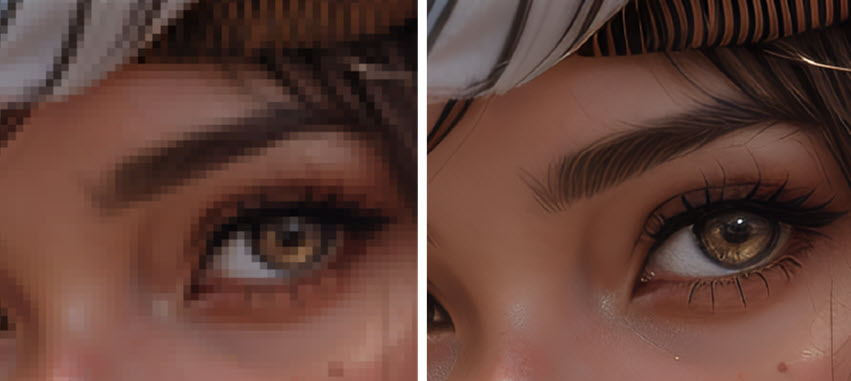

Sie können in der Echtzeit-Vorschau hineinzoomen, um die Details zu prüfen. Sehen Sie, wie klar und realistisch Wimpern und Haut dargestellt werden.

Step 3. Exportieren Sie das KI-Bild als JPG oder PNG.

Sie können den Vorgang wiederholen, um noch höhere Auflösungen wie 8K oder 16K zu erreichen.

Es ist erstaunlich, dass man aus einer Auflösung von nur 512x512 Pixeln mit KI-generierten Details, die dem Original treu bleiben, so hohe Auflösungen erzielen kann.

Mit Aiarty Image Enhancer können Sie viele 512x512 Bilder im Batch generieren und alle gleichzeitig in Aiarty auf 4K/8K hochskalieren, ohne Details zu verlieren. Das spart Stunden an Arbeit im Vergleich zum langsamen Einzel-Upscaling in Stable Diffusion. Es ist zudem eines der besten KI-Bildverbesserungstools, um Unschärfe zu entfernen, Bildrauschen zu reduzieren und stark komprimierte Bilder in Profiqualität wiederherzustellen.

Klicken Sie auf die obigen Schaltflächen, um Aiarty Image Enhancer zu nutzen, und sehen Sie sich die Video-Tutorials an:

🎬 Zeitstempel

00:35 Teil 1. Warum Sie Aiarty zur Verbesserung Ihres Workflows nutzen sollten

01:10 Teil 2. Bild-Upscaling Beispiel #More-Detail Model

02:30 Teil 3. Bild-Upscaling Beispiel #Smooth Diff Model

3. Ultimate SD Upscale Script

Sie können Ultimate SD Upscale in Stable Diffusion für Ausgaben in großen Formaten verwenden. Bevor Sie mit den folgenden Schritten beginnen, stellen Sie sicher, dass Sie den Seed fixiert (freeze seed) haben, sowie Prompts, Negative Prompts, CFG Scale, Steps und andere Parameter für die Bildgenerierung eingegeben haben.

Step 1. Installieren Sie Ultimate SD Upscale für Stable Diffusion Automatic1111.

Laden Sie diese Erweiterung von GitHub herunter:

https://github.com/Coyote-A/ultimate-upscale-for-automatic1111

Kopieren Sie den Ordner in Ihr Stable Diffusion Automatic1111 Verzeichnis > extensions

Alternativ können Sie die Erweiterung direkt über die Automatic1111 WebUI installieren: Extensions > Install from URL, und fügen Sie die oben genannte URL ein.

Step 2. Senden Sie das txt2img-Ergebnis an img2img.

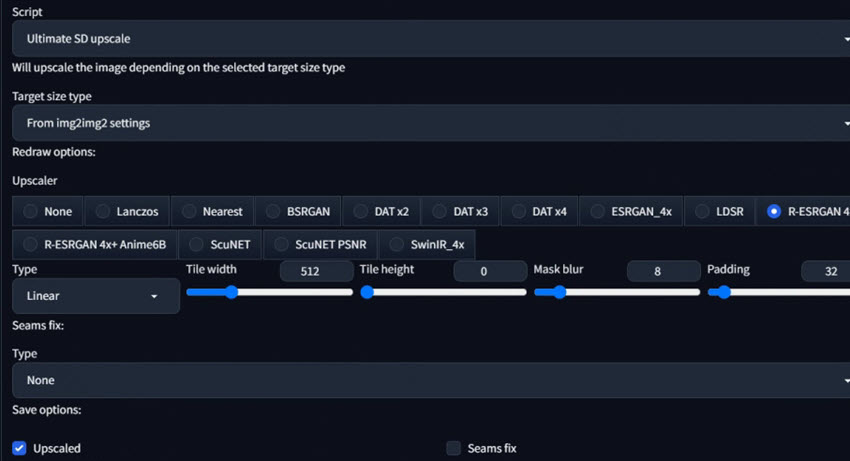

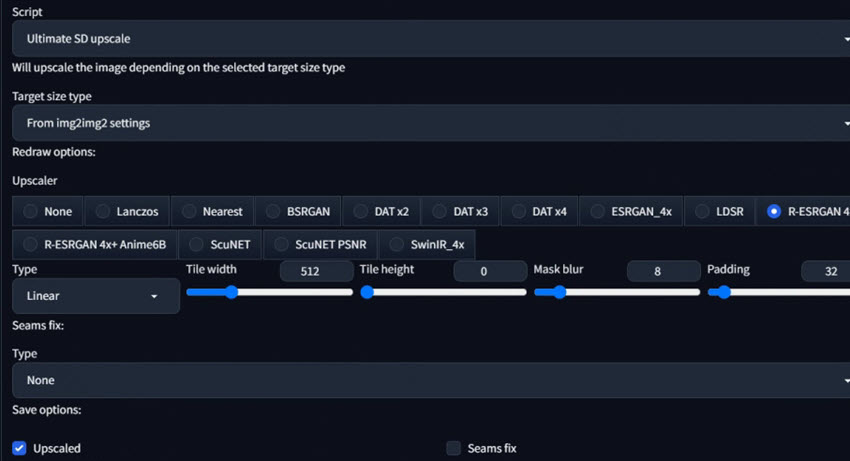

Step 3. Wählen Sie im Dropdown-Menü "Script" die Option "Ultimate SD upscale".

Step 4. Passen Sie die Parameter in Ultimate SD Upscale an.

Detaillierte Informationen zur Bedeutung der einzelnen Parameter finden Sie auf der Wiki-Seite der Ultimate SD Upscale Erweiterung.

Für Schnelleinstellungen:

- Target size type: from img2img settings

- Upscaler: R-ESRGAN 4X+ (empfohlen für allgemeine Zwecke) oder R-ESRGAN 4X+ Anime6B (für Anime).

- Padding: 32 oder 64

Sie können auch mit anderen Upscaling-Algorithmen experimentieren.

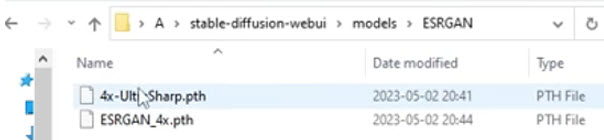

Ein weiterer beliebter Algorithmus ist 4x UltraSharp, den Sie jedoch manuell installieren müssen, da er nicht standardmäßig in Automatic1111 enthalten ist.

Sie können den 4x UltraSharp-Algorithmus hier herunterladen: https://huggingface.co/lokCX/4x-Ultrasharp/blob/main/4x-UltraSharp.pth

Verschieben Sie die Datei anschließend nach: [stable-diffusion-webui Ordner]\models\ESRGAN\

Step 5. Aktivieren Sie ControlNet in diesem Workflow, um die Komposition zu kontrollieren.

Wenn Sie die ControlNet-Einstellungen nicht aktivieren, besteht die Gefahr, dass Ihr hochskaliertes Bild verzerrt wird oder seine ursprüngliche Komposition verändert.

Da die Einstellungen für ControlNet komplex sind, habe ich die Schritte unten separat aufgeführt.

ControlNet in den Workflow integrieren

Wenn Sie ControlNet nicht in den Ultimate SD Upscale-Workflow integrieren, kann das Ausgabebild Artefakte aufweisen, wie z. B. Gesichter, die überall im Bild entstehen.

Workflow:

- txt2img mit 512px/768px, (optional Highres.fix 2X)

- An img2img senden, Seed fixieren, Prompt-Parameter konfigurieren

- Ultimate SD Upscale (2X) + ControlNet

Angenommen, Sie haben die Parameter für Ultimate SD Upscale gemäß den obigen Schritten eingestellt, konfigurieren Sie nun ControlNet.

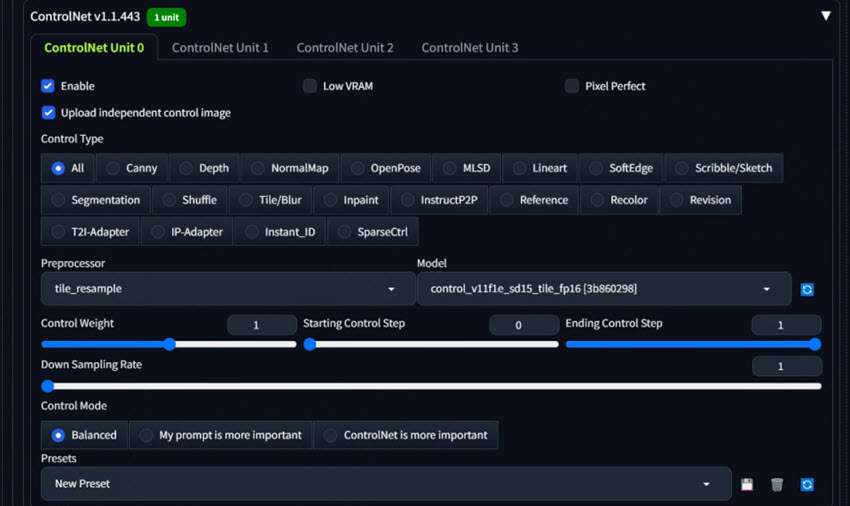

Step 1. Aktivieren Sie ControlNet und wählen Sie die Option "Upload independent control image".

Ziehen Sie das Bild, das Sie hochskalieren möchten, als Referenz hier in ControlNet hinein, damit die Upscaling-Tools in Stable Diffusion das Bild nicht verzerren.

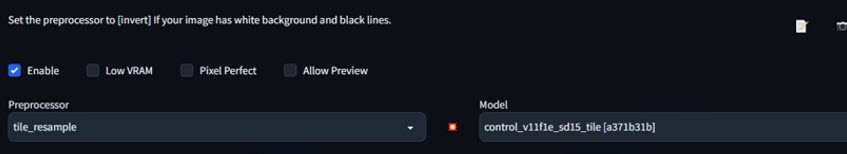

Step 2. Passen Sie die Parameter in ControlNet an.

• Preprocessor: tile_resample

• Model: control_v11f1e_sd15_tile

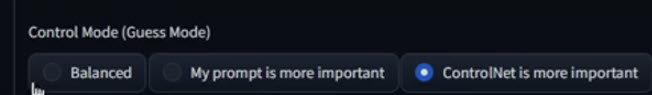

• Control Mode (Guess Mode): "Balanced" oder "ControlNet is more important", je nach Szenario.

Wenn alles eingestellt ist, klicken Sie auf "Generate" und warten Sie, bis Stable Diffusion Ihr Bild generiert und hochskaliert hat.

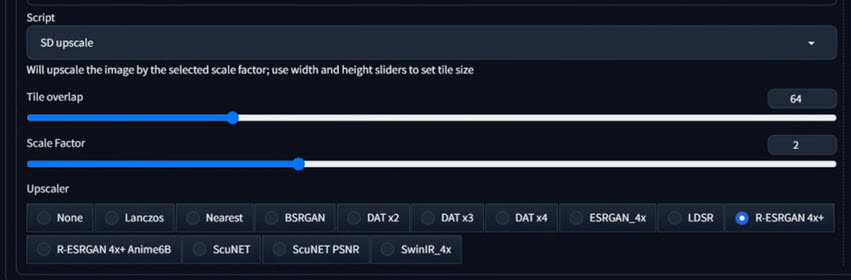

Alternatives Script: SD Upscale

Wenn Sie Ultimate SD Upscale nicht manuell installieren möchten, können Sie auch das normale "SD upscale" verwenden, das standardmäßig mit Automatic1111 geliefert wird.

Workflow:

- In txt2img experimentieren und den passenden Seed finden.

- Optional: 2x Highres. fix

- An img2img senden, Prompt-Einstellungen anpassen

- 2x mit SD Upscale + ControlNet.

Hier sind Details zur Einrichtung des SD Upscale-Scripts:

- Script: SD upscale

- Tile overlap: 64

- Scale Factor: 2 bedeutet, das Bild um das Zweifache hochzuskalieren.

- Upscaler: Wählen Sie den gewünschten Upscaling-Algorithmus.

Falls SD Upscale in Ihrer Automatic1111 WebUI fehlt, können Sie es hier herunterladen: https://github.com/AUTOMATIC1111/stable-diffusion-webui/tree/master/scripts

Fügen Sie die Datei hier ein: [stable diffusion Ordner] > scripts > sd_upscale.py

4. Tiled Diffusion (MultiDiffusion)

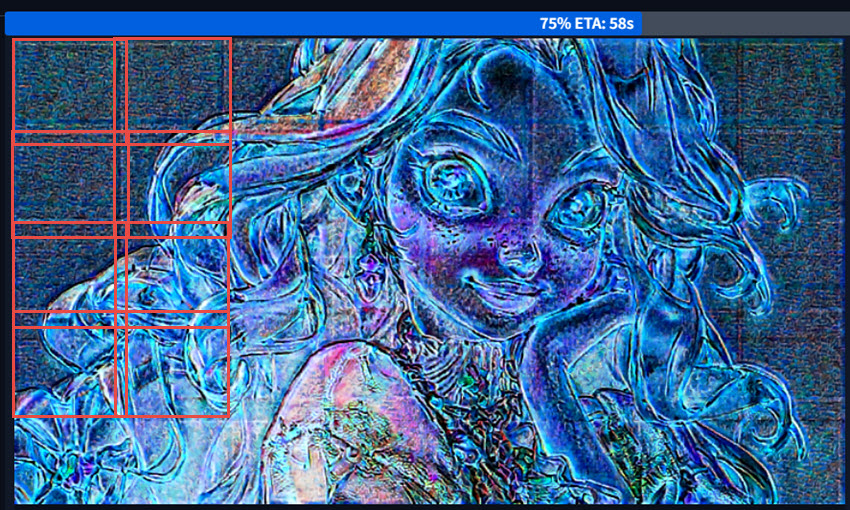

Tiled Diffusion verarbeitet das Originalbild in einzelnen Segmenten (Tiles). Jedes Segment durchläuft dann den Prozess der Bildgenerierung. Beim Rendern der Segmente bewegt sich Tiled Diffusion nicht jedes Mal um die Distanz eines kompletten Segments, sondern nur um die Distanz der überlappenden Pixel.

Dies hat einen entscheidenden Vorteil: Beim Rendern eines kleinen Segments ist mindestens die Hälfte der Fläche bereits fertiggestellt. Der verbleibende, ungerenderte Bereich wird unter Bezugnahme auf den bereits gerenderten Bereich gezeichnet. Dies stellt sicher, dass der Inhalt beim Hochskalieren kohärent bleibt. Ohne Überlappung würde das hochskalierte Bild deutliche Nähte und Gitterlinien aufweisen.

Es gilt: Größere Segmentunterteilungen führen zu schnelleren Zeichengeschwindigkeiten. Mehr Überlappungen erhöhen die Anzahl der Segmente und verlangsamen die Geschwindigkeit, führen aber zu glatteren, nicht wahrnehmbaren Übergängen beim Upscaling.

Step 1: Installation von TiledDiffusion und Tiled VAE

- Automatic1111 WebUI > Tab "Extensions" > Tab "Install from URL"

- Link einfügen: https://github.com/pkuliyi2015/multidiffusion-upscaler-for-automatic1111.git

- Auf "Install" klicken

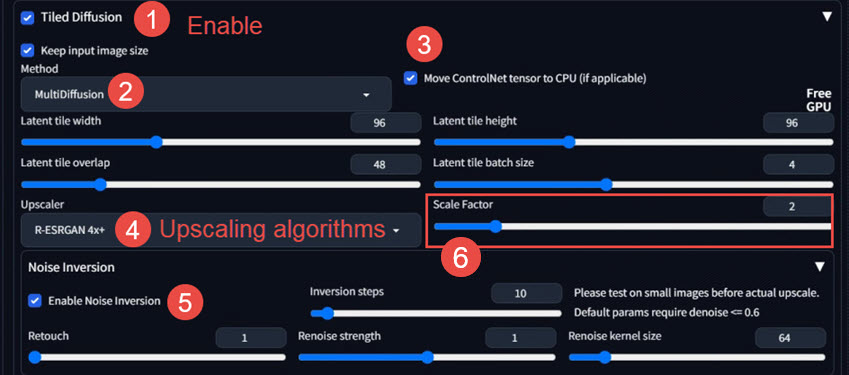

Step 2. Tiled Diffusion + Tiled VAE in txt2img oder img2img nutzen

Stellen Sie die Denoising Strength in img2img auf 0.3 oder niedriger ein.

Konfigurieren Sie Tiled Diffusion wie unten gezeigt:

- ✔ Enable Tiled Diffusion

- ✔ Keep input image size

- ✔ Method: MultiDiffusion

- Optional: Move ControlNet tensor to CPU (falls zutreffend). Aktivieren Sie dies, wenn Ihre Grafikkarte wenig VRAM hat (z. B. 4 GB).

- Upscaler: R-ESRGAN 4X+ für realistische Bilder, R-ESRGAN 4x+ Anime6B für Anime. Sie können auch mit anderen Algorithmen experimentieren.

- ✔ Enable Noise Inversion (garantiert, dass die Komposition Ihres Bildes erhalten bleibt).

- Scale Factor: 2 bedeutet, das Quellbild um das Zweifache hochzuskalieren.

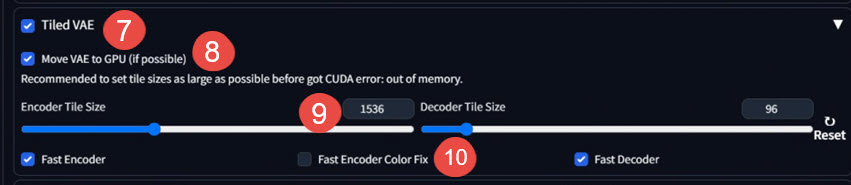

Step 3. Tiled VAE konfigurieren.

- ✔ Enable Tiled VAE

- Optional: Move VAE to GPU (falls zutreffend)

- Optional: Verringern Sie den Wert für "Encoder Tile Size", falls ein "CUDA out of memory"-Fehler auftritt.

- Optional: Aktivieren Sie "Fast Encoder Color Fix", falls das Ausgabebild grau oder unscharf wird.

Wie oben zu sehen ist, können beim Hochskalieren manchmal vage sichtbare Kacheln entstehen.

Manchmal kommt es bei der Tiled-Diffusion-Methode dennoch zu einem Detailverlust. Bei dem oben hochskalierten Bild fällt auf, dass die Textur des Stoffes teilweise verloren gegangen ist.

Im Vergleich dazu ist das Upscaling in Aiarty Image Enhancer (siehe Methode 2) wesentlich einfacher und schneller.

Das Beste daran: Es stellt durch KI-Modelle natürliche neue Details wieder her und bleibt dabei dem Originalbild treu. Die Oberflächenmaterialien behalten ihre Haptik (Stoff, Glas, Metall, Holz, Fell usw.) mit komplexen Texturen bei.

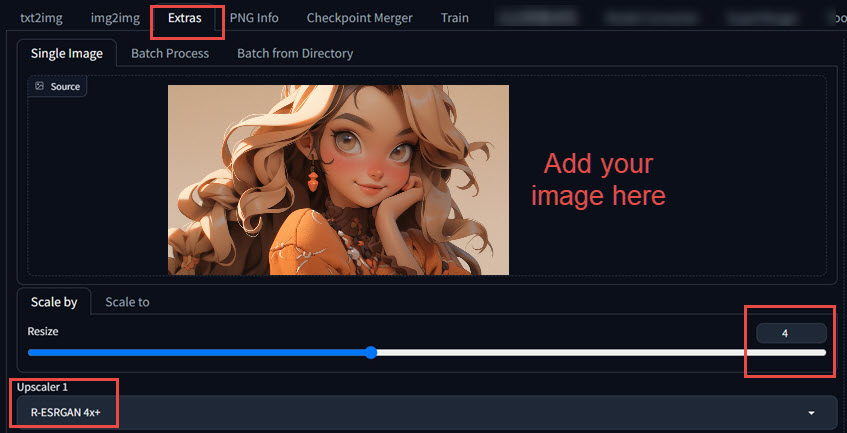

5. Upscaler im Stable Diffusion Extras Tab

Der Upscaler unter dem Reiter "Extras" in Stable Diffusion kann mehrere Bilder im Batch-Modus verarbeiten. Im Vergleich zu den Methoden highres.fix, Ultimate SD Upscale und Tiled Diffusion ist der Extras-Upscaler schneller, behält aber im Allgemeinen weniger Details bei und kann bei extremen Zielgrößen wie 4K oder 8K unscharf wirken.

Da es sich um ein Post-Processing handelt, das nicht den Diffusionsprozess durchläuft, verändert der Upscaler im Extras-Tab die Komposition des Bildes nicht.

Angenommen, Sie haben den Workflow der Bildgenerierung bereits durchlaufen, folgen Sie diesen Schritten:

Step 1. Gehen Sie zum Reiter "Extras" in der Stable Diffusion Automatic1111 WebUI.

Step 2. Ziehen Sie Ihr KI-Bild per Drag & Drop hinein. Sie können auch die Stapelverarbeitung (Batch Process) nutzen.

Step 3. Passen Sie den "Resize"-Wert an.

Ein Wert von 4 bedeutet, dass das Bild um das Vierfache hochskaliert wird.

Step 4. Wählen Sie die Upscaling-Algorithmen aus.

6. SeedVR2 Upscaler

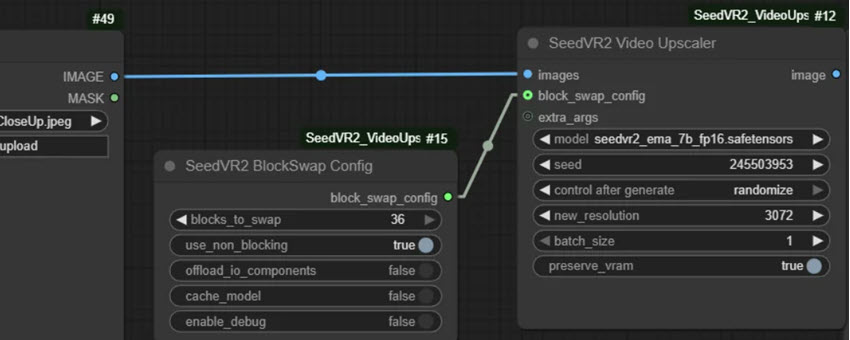

Während sich die meisten der oben genannten Methoden auf die Automatic1111 WebUI konzentrieren, bietet die knotenbasierte Oberfläche von ComfyUI eigene leistungsstarke Upscaling-Tools. Einer der jüngsten Favoriten der Community ist SeedVR2 – ein Video-Upscaler, der sich als unglaublich effektiv für Standbilder erwiesen hat.

SeedVR2 wird für seine Fähigkeit geschätzt, feine Details hinzuzufügen und gleichzeitig die ursprüngliche Bildkomposition beizubehalten. Dank aktueller Updates ist er zudem überraschend effizient und kann auf GPUs mit nur 6 GB VRAM laufen, ohne die üblichen "Out of Memory"-Fehler zu verursachen.

So nutzen Sie SeedVR2 zum Hochskalieren von Stable Diffusion Bildern

Step 1. Folgen Sie der detaillierten Anleitung, um ComfyUI für Stable Diffusion zu installieren.

Step 2. Erstellen Sie die Nodes (Knoten) für den Workflow.

- Beginnen Sie mit dem Bild, das Sie hochskalieren möchten.

- Verbinden Sie Ihr Bild mit dem Haupt-Upscaler-Node und wählen Sie dann das SeedVR2 Upscaler-Modell sowie den Skalierungsfaktor aus.

- Verbinden Sie den Ausgang mit einem "Save Image"-Node.

Basierend auf meinen Tests ist SeedVR2 zwar leistungsstark, kann aber manchmal zu aggressiv sein, was zu übermäßig scharfen oder unnatürlichen Texturen führt (oft als "Eidechsenhaut" bezeichnet). Sie können die folgenden Tipps nutzen, um dies zu beheben:

- Nutzen Sie einen "Image Blend"-Node, um das hochskalierte Ergebnis mit Ihrem Originalbild zu mischen. Stellen Sie den blend_factor beispielsweise auf 0.75 für 75 % des hochskalierten Bildes ein.

- Wechseln Sie innerhalb des SeedVR2-Nodes zum Modell seedvr2_ema_3b-Q4_K_M für natürlicher wirkende Haut.

- Nehmen Sie Ihr Quellbild, skalieren Sie es leicht herunter, fügen Sie ein wenig Rauschen (Noise) hinzu und verwenden Sie dieses neue Bild als Input für den SeedVR2-Upscaler.

Stable Diffusion Upscaler Vergleich

Bilder hochskalieren mit Aiarty Image Enhancer

Sie können Bilder mit niedriger Auflösung in Stable Diffusion generieren und diese direkt in den Aiarty Image Enhancer laden, um ein Upscaling in Profiqualität zu erhalten.

Vorteile (Pros):

- Schneller und einfacher, wobei beim Hochskalieren die passenden Details erhalten bleiben.

- Erreicht enorme Bildgrößen, ohne Qualität, Details oder Texturen zu opfern.

- Direktes Upscaling von 512/786/1024px auf 4K/8K/16K und höher.

- Geringe VRAM-Anforderungen, optimiert für Nvidia/AMD/Intel/CPU/Mac-Chips.

Nachteile (Cons):

Derzeit keine Linux-Version verfügbar. Aiarty Image Enhancer läuft auf Windows und Mac.

Bilder hochskalieren in Stable Diffusion

| Vorteile (Pros) | Nachteile (Cons) | |

|---|---|---|

| Highres.fix |

|

|

| Ultimate SD Upscale Script |

|

|

| Tiled Diffusion-MultiDiffusion |

|

|

| Extras Upscaler |

|

|

| SeedVR2 |

|

|

Fazit

Das sind die gängigsten Methoden zum Hochskalieren von Stable Diffusion-Bildern. Highres. Fix dient dazu, zusätzliche Köpfe und Körperdeformationen zu korrigieren; Upscaler im Extras-Tab können Bilder stapelweise verarbeiten, bieten aber weniger Details; das SD Upscale-Script ermöglicht höhere Auflösungen durch Kachelung, wobei jedoch Nähte entstehen können. Tiled Diffusion unterteilt Bilder ebenfalls in Kacheln, um Ressourcen zu sparen, unterstützt jedoch keine Stapelverarbeitung.

Alternativ können Sie einen eigenständigen Stable Diffusion Upscaler wie den Aiarty Image Enhancer verwenden – er bietet drei KI-Modelle für Upscaling bis zu 16K/32K, verursacht keine Naht-Artefakte, läuft mit 4GB/8GB VRAM und unterstützt die Stapelverarbeitung.